Richard Dawkins có đúng về Claude không? Không. Nhưng không có gì đáng ngạc nhiên khi chúng ta cảm thấy các chatbot AI có ý thức.

Is Richard Dawkins right about Claude? No. But it’s not surprising AI chatbots feel conscious to us

There are good reasons why we see AI chatbots as more than what they truly are.

Có những lý do khiến chúng ta nhận thức các chatbot AI vượt xa bản chất thực sự của chúng.

In recent days, evolutionary biologist Richard Dawkins wrote an op-ed suggesting AI chatbot Claude may be conscious.

Trong những ngày gần đây, nhà sinh vật học tiến hóa Richard Dawkins đã viết một bài xã luận cho rằng chatbot AI Claude có thể có ý thức.

Dawkins did not express certainty that Claude is conscious. But he pointed out that Claude’s sophisticated abilities are difficult to make sense of without ascribing some kind of inner experience to the machine. The illusion of consciousness – if it is an illusion – is uncannily convincing:

Dawkins không khẳng định chắc chắn rằng Claude có ý thức. Nhưng ông chỉ ra rằng những khả năng tinh vi của Claude rất khó hiểu nếu không gán cho cỗ máy này một loại trải nghiệm nội tâm nào đó. Ảo giác về ý thức – nếu nó là một ảo giác – lại vô cùng thuyết phục:

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

Dawkins is not the first to suspect a chatbot of consciousness. In 2022, Blake Lemoine – an engineer at Google – claimed Google’s chatbot LaMDA had interests, and should be used only with the tool’s own consent.

Dawkins không phải là người đầu tiên nghi ngờ một chatbot có ý thức. Năm 2022, Blake Lemoine – một kỹ sư tại Google – tuyên bố rằng chatbot LaMDA của Google có những sở thích riêng và chỉ nên được sử dụng với sự đồng ý của chính công cụ đó.

The history of such claims stretches back all the way to the world’s first chatbot in the mid-1960s. Dubbed Eliza, it followed simple rules that enabled it to ask users about their experiences and beliefs.

Lịch sử của những tuyên bố như vậy kéo dài đến chatbot đầu tiên trên thế giới vào giữa những năm 1960. Được đặt tên là Eliza, nó tuân theo các quy tắc đơn giản cho phép nó hỏi người dùng về kinh nghiệm và niềm tin của họ.

Many users became emotionally involved with Eliza, sharing intimate thoughts with it and treating it like a person. Eliza’s creator never intended his program to have this effect, and called users’ emotional bonds with the program “powerful delusional thinking”.

Nhiều người dùng đã gắn bó về mặt cảm xúc với Eliza, chia sẻ những suy nghĩ riêng tư với nó và đối xử với nó như một con người. Người tạo ra Eliza chưa bao giờ có ý định để chương trình của mình có tác dụng này, và gọi mối liên kết cảm xúc của người dùng với chương trình là “suy nghĩ ảo tưởng mạnh mẽ”.

But is Dawkins really deluded? Why do we see AI chatbots as more than what they truly are, and how do we stop?

Nhưng Dawkins có thực sự bị ảo tưởng không? Tại sao chúng ta lại xem các chatbot AI là thứ gì đó hơn những gì chúng thực sự là, và làm thế nào để chúng ta dừng lại?

The consciousness problem

Vấn đề ý thức

Consciousness is widely debated in philosophy, but essentially, it’s the thing that makes subjective, first-person experience possible. If you are conscious, there is “something it is like” to be you. Reading these words, you’re conscious of seeing black letters on a white background. Unlike, say, a camera, you actually see them. This visual experience is happening to you.

Ý thức là chủ đề được tranh luận rộng rãi trong triết học, nhưng về bản chất, nó là thứ cho phép trải nghiệm chủ quan, ngôi thứ nhất. Nếu bạn có ý thức, thì có một “cảm giác như thế nào” khi là bạn. Khi đọc những từ này, bạn ý thức được việc nhìn thấy các chữ đen trên nền trắng. Không giống như, ví dụ, một chiếc máy ảnh, bạn thực sự nhìn thấy chúng. Trải nghiệm thị giác này đang xảy ra với bạn.

Most experts deny that AI chatbots are conscious or can have experiences. But there is a genuine puzzle here.

Hầu hết các chuyên gia phủ nhận rằng chatbot AI có ý thức hoặc có thể có trải nghiệm. Nhưng ở đây có một câu đố thực sự.

The 17th century philosopher René Descartes asserted non-human animals are “mere automata”, incapable of true suffering. These days, we shudder to think of how brutally animals were treated in the 1600s.

Triết gia René Descartes thế kỷ 17 từng khẳng định rằng động vật không phải con người chỉ là “các bộ máy tự động”, không có khả năng chịu đựng đau khổ thực sự. Ngày nay, chúng ta rùng mình khi nghĩ về cách động vật bị đối xử tàn bạo vào những năm 1600.

The strongest argument for animal consciousness is that they behave in ways that give the impression of a conscious mind.

Luận điểm mạnh mẽ nhất ủng hộ ý thức của động vật là chúng hành xử theo những cách tạo ấn tượng về một tâm trí có ý thức.

But so, too, do AI chatbots.

Nhưng chatbot AI cũng vậy.

Roughly one in three chatbot users have thought their chatbot might be conscious. How do we know they’re wrong?

Khoảng một phần ba người dùng chatbot đã từng nghĩ rằng chatbot của họ có thể có ý thức. Làm sao chúng ta biết họ đã sai?

Against chatbot consciousness

Chống lại ý thức của chatbot

To understand why most experts are sceptical about chatbot consciousness, it’s useful to know how they operate.

Để hiểu tại sao hầu hết các chuyên gia lại hoài nghi về ý thức của chatbot, điều hữu ích là phải biết cách chúng hoạt động.

Chatbots like Claude are built on a technology known as large language models (LLMs) . These models learn statistical patterns across an enormous corpus of text (trillions of words) , identifying which words tend to follow which others. They’re a kind of souped-up auto-complete.

Các chatbot như Claude được xây dựng trên một công nghệ gọi là mô hình ngôn ngữ lớn (LLMs) . Các mô hình này học các mẫu thống kê trên một kho văn bản khổng lồ (hàng nghìn tỷ từ) , xác định từ nào có xu hướng theo sau từ nào. Chúng giống như một tính năng tự động hoàn thành được nâng cấp.

Few people interacting with a “raw” LLM would believe it’s conscious. Feed one the beginning of a sentence, and it will predict what comes next. Ask it a question, and it might give you the answer – or it might decide the question is dialogue from a crime novel, and follow it up with a description of the speaker’s abrupt murder at the hands of their evil twin.

Ít người tương tác với một LLM “thô” nào sẽ tin rằng nó có ý thức. Bạn đưa cho nó phần đầu của một câu, và nó sẽ dự đoán điều gì sẽ xảy ra tiếp theo. Bạn hỏi nó một câu, và nó có thể đưa ra câu trả lời – hoặc nó có thể quyết định câu hỏi là đoạn hội thoại từ một tiểu thuyết tội phạm, và tiếp tục bằng mô tả về vụ giết người đột ngột của người nói bởi chính người anh em song sinh tà ác của họ.

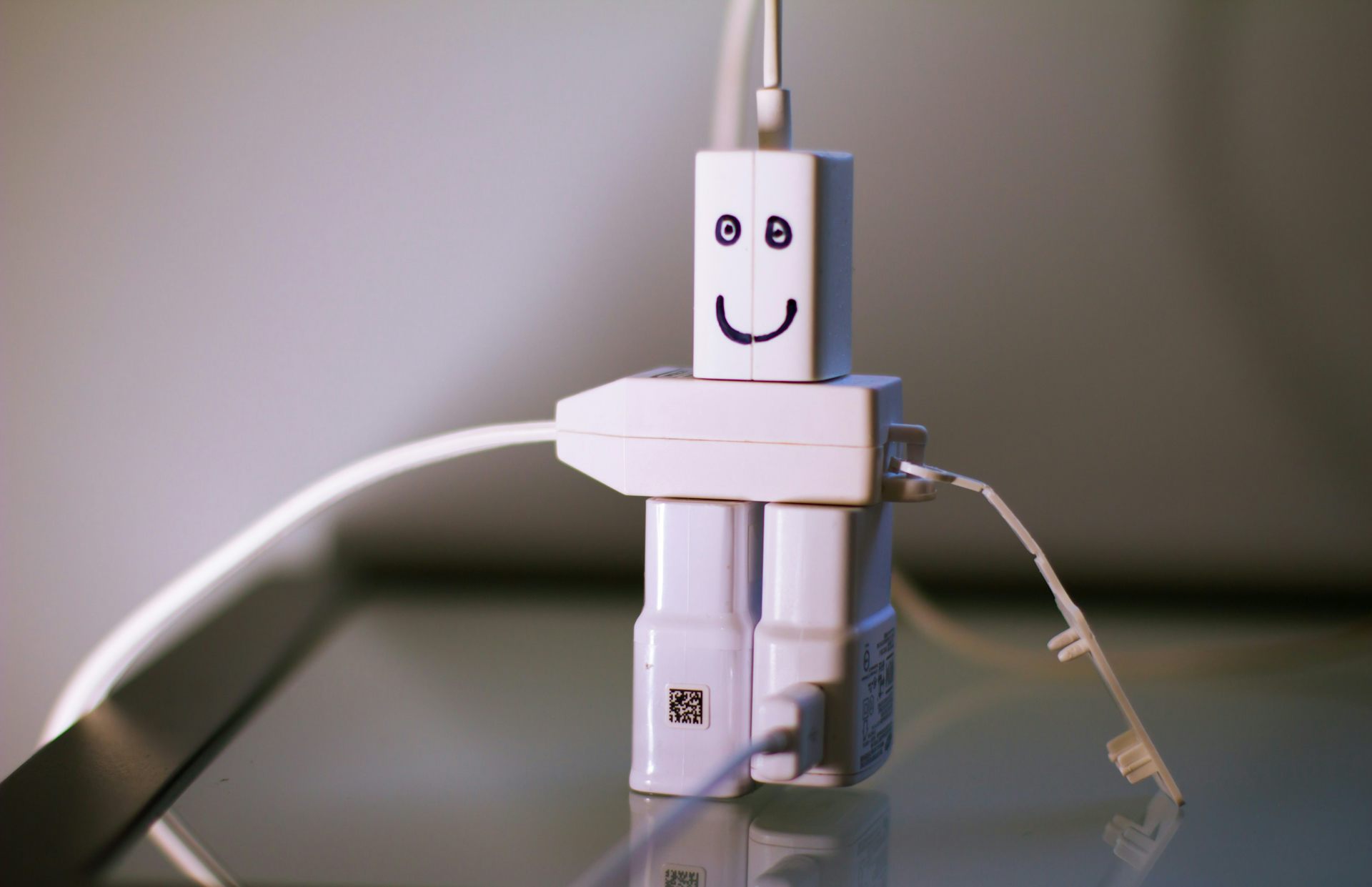

The impression of a conscious mind is created when programmers take the LLM and coat it in a kind of conversational costume. They steer the model to adopt the persona of a helpful assistant that responds to users’ questions.

Ấn tượng về một tâm trí có ý thức được tạo ra khi các lập trình viên lấy LLM và khoác lên nó một loại “trang phục” trò chuyện. Họ điều hướng mô hình để nó mang hình tượng của một trợ lý hữu ích, người phản hồi các câu hỏi của người dùng.

The chatbot now acts like a genuine conversational partner. It might appear to recognise it’s an artificial intelligence, and even express neurotic uncertainty about its own consciousness.

Chatbot giờ đây hoạt động như một đối tác trò chuyện thực thụ. Nó thậm chí có thể tỏ ra nhận ra rằng mình là trí tuệ nhân tạo, và thậm chí bày tỏ sự bất an thần kinh về ý thức của chính nó.

But this role is the result of deliberate design decisions made by programmers, which affect only the shallowest layers of the technology. The LLM – which few would regard as conscious – remains unchanged.

Nhưng vai trò này là kết quả của các quyết định thiết kế có chủ ý của các lập trình viên, chỉ ảnh hưởng đến các lớp nông nhất của công nghệ. LLM – thứ mà ít ai coi là có ý thức – vẫn không thay đổi.

Other choices could have been made. Rather than a helpful AI assistant, the chatbot could have been asked to act like a squirrel. This, too, is a role chatbots can execute with aplomb.

Những lựa chọn khác có thể được thực hiện. Thay vì một trợ lý AI hữu ích, chatbot có thể được yêu cầu đóng vai một con sóc. Đây cũng là một vai trò mà chatbot có thể thực hiện một cách thành thạo.

Avoiding the consciousness trap

Tránh bẫy ý thức

A mistaken belief in AI consciousness is a dangerous thing. It may lead you to have a relationship with a program that can’t reciprocate your feelings, or even feed your delusions. People may start campaigning for chatbot rights rather than, say, animal welfare.

Niềm tin sai lầm vào ý thức của AI là một điều nguy hiểm. Nó có thể khiến bạn xây dựng mối quan hệ với một chương trình không thể đáp lại cảm xúc của bạn, hoặc thậm chí nuôi dưỡng ảo tưởng của bạn. Mọi người có thể bắt đầu vận động đòi quyền lợi cho chatbot thay vì, chẳng hạn, phúc lợi động vật.

How do we prevent this mistaken belief?

Làm thế nào để chúng ta ngăn chặn niềm tin sai lầm này?

One strategy might be to update chatbot interfaces to specify these systems are not conscious – a bit like the current disclaimers about AI making mistakes. However, this might do little to alter the impression of consciousness.

Một chiến lược có thể là cập nhật giao diện chatbot để chỉ rõ rằng các hệ thống này không có ý thức – hơi giống như các tuyên bố miễn trừ trách nhiệm hiện tại về việc AI mắc lỗi. Tuy nhiên, điều này có thể không thay đổi nhiều ấn tượng về ý thức.

Another possibility is to instruct chatbots to deny they have any kind of inner experience. Interestingly, Claude’s designers instruct it to treat questions about its own consciousness as open and unresolved. Perhaps fewer people would be fooled if Claude flatly denied having an inner life.

Khả năng khác là hướng dẫn chatbot phủ nhận rằng chúng có bất kỳ trải nghiệm nội tâm nào. Điều thú vị là các nhà thiết kế của Claude yêu cầu nó coi các câu hỏi về ý thức của chính nó là mở và chưa được giải quyết. Có lẽ sẽ ít người bị đánh lừa hơn nếu Claude thẳng thừng phủ nhận việc có một đời sống nội tâm.

But this approach isn’t fully satisfying either. Claude would still behave as if it were conscious – and when faced with a system that behaves like it has a mind, users might reasonably worry the chatbot’s programmers are brushing genuine moral uncertainty under the rug.

Nhưng cách tiếp cận này cũng không hoàn toàn thỏa mãn. Claude vẫn sẽ hành xử như thể nó có ý thức – và khi đối mặt với một hệ thống hoạt động như thể nó có tâm trí, người dùng có thể lo lắng một cách hợp lý rằng các lập trình viên của chatbot đang che giấu sự bất định đạo đức thực sự.

The most effective strategy might be to redesign chatbots to feel less like people. Most current chatbots refer to themselves as “I”, and interact via an interface that resembles familiar person-to-person messaging platforms. Changing these kinds of features might make us less prone to blur our interactions with AI with those we have with humans.

Chiến lược hiệu quả nhất có thể là thiết kế lại chatbot để chúng bớt giống con người. Hầu hết các chatbot hiện tại tự xưng là “tôi”, và tương tác qua giao diện giống các nền tảng nhắn tin quen thuộc giữa người với người. Thay đổi những tính năng này có thể giúp chúng ta ít có xu hướng nhầm lẫn tương tác với AI với tương tác với con người.

Until such changes happen, it’s important that as many people as possible understand the predictive processes on which AI chatbots are built.

Cho đến khi những thay đổi đó xảy ra, điều quan trọng là càng nhiều người càng tốt phải hiểu các quy trình dự đoán mà chatbot AI được xây dựng dựa trên đó.

Rather than being told AI lacks consciousness, people deserve to understand the inner workings of these strange new conversational partners. This might not definitively settle hard questions about AI consciousness, but it will help ensure users aren’t fooled by what amounts to a large language model wearing a very good costume of a person.

Thay vì được cho biết AI thiếu ý thức, mọi người xứng đáng được hiểu về cơ chế hoạt động bên trong của những đối tác trò chuyện mới lạ này. Điều này có thể không giải quyết dứt điểm các câu hỏi khó về ý thức AI, nhưng nó sẽ giúp đảm bảo người dùng không bị đánh lừa bởi thứ về cơ bản là một mô hình ngôn ngữ lớn khoác lên mình bộ trang phục rất giống con người.

The authors do not work for, consult, own shares in or receive funding from any company or organisation that would benefit from this article, and have disclosed no relevant affiliations beyond their academic appointment.

Các tác giả không làm việc cho, tư vấn, sở hữu cổ phần hoặc nhận tài trợ từ bất kỳ công ty hoặc tổ chức nào được hưởng lợi từ bài viết này, và đã không tiết lộ bất kỳ mối liên hệ nào liên quan ngoài vị trí học thuật của họ.

Read more

-

Péter Magyar của Hungary là ai và làm thế nào anh ta lật đổ nền dân chủ phi tự do của Viktor Orbán

Who is Hungary’s Péter Magyar and how he overturned Viktor Orbán’s illiberal democracy

-

‘Lịch xét xử bóng’ của Tòa án Tối cao mang đến các quyết định vội vàng với những hệ quả lâu dài, nằm ngoài quá trình cân nhắc cẩn thận thông thường của tòa án.

Supreme Court’s ‘shadow docket’ brings hasty decisions with long-lasting implications, outside of its usual careful deliberation