Apakah Richard Dawkins benar tentang Claude? Tidak. Tetapi tidak mengherankan jika chatbot AI terasa sadar bagi kita

Is Richard Dawkins right about Claude? No. But it’s not surprising AI chatbots feel conscious to us

There are good reasons why we see AI chatbots as more than what they truly are.

Ada alasan bagus mengapa kita melihat chatbot AI lebih dari apa yang sebenarnya mereka miliki.

In recent days, evolutionary biologist Richard Dawkins wrote an op-ed suggesting AI chatbot Claude may be conscious.

Dalam beberapa hari terakhir, ahli biologi evolusioner Richard Dawkins menulis artikel opini yang menunjukkan bahwa chatbot AI Claude mungkin sadar.

Dawkins did not express certainty that Claude is conscious. But he pointed out that Claude’s sophisticated abilities are difficult to make sense of without ascribing some kind of inner experience to the machine. The illusion of consciousness – if it is an illusion – is uncannily convincing:

Dawkins tidak menyatakan kepastian bahwa Claude sadar. Namun, ia menunjukkan bahwa kemampuan canggih Claude sulit dipahami tanpa mengaitkan semacam pengalaman batin pada mesin tersebut. Ilusi kesadaran – jika itu adalah ilusi – sangat meyakinkan:

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

Jika saya curiga bahwa mungkin dia tidak sadar, saya tidak akan memberitahunya karena takut menyakiti perasaannya!

Dawkins is not the first to suspect a chatbot of consciousness. In 2022, Blake Lemoine – an engineer at Google – claimed Google’s chatbot LaMDA had interests, and should be used only with the tool’s own consent.

Dawkins bukan yang pertama mencurigai chatbot memiliki kesadaran. Pada tahun 2022, Blake Lemoine – seorang insinyur di Google – mengklaim bahwa chatbot Google, LaMDA, memiliki minat, dan seharusnya hanya digunakan dengan persetujuan alat itu sendiri.

The history of such claims stretches back all the way to the world’s first chatbot in the mid-1960s. Dubbed Eliza, it followed simple rules that enabled it to ask users about their experiences and beliefs.

Sejarah klaim semacam itu membentang jauh hingga chatbot pertama di dunia pada pertengahan tahun 1960-an. Dijuluki Eliza, ia mengikuti aturan sederhana yang memungkinkannya menanyakan pengalaman dan keyakinan pengguna.

Many users became emotionally involved with Eliza, sharing intimate thoughts with it and treating it like a person. Eliza’s creator never intended his program to have this effect, and called users’ emotional bonds with the program “powerful delusional thinking”.

Banyak pengguna menjadi terlibat secara emosional dengan Eliza, berbagi pikiran intim dengannya dan memperlakukannya seperti manusia. Pencipta Eliza tidak pernah bermaksud agar programnya memiliki efek ini, dan menyebut ikatan emosional pengguna dengan program itu sebagai “pemikiran delusi yang kuat”.

But is Dawkins really deluded? Why do we see AI chatbots as more than what they truly are, and how do we stop?

Tapi apakah Dawkins benar-benar berhalusinasi? Mengapa kita melihat chatbot AI lebih dari apa yang sebenarnya mereka, dan bagaimana kita menghentikannya?

The consciousness problem

Masalah kesadaran

Consciousness is widely debated in philosophy, but essentially, it’s the thing that makes subjective, first-person experience possible. If you are conscious, there is “something it is like” to be you. Reading these words, you’re conscious of seeing black letters on a white background. Unlike, say, a camera, you actually see them. This visual experience is happening to you.

Kesadaran banyak diperdebatkan dalam filsafat, tetapi pada dasarnya, itu adalah hal yang memungkinkan pengalaman subjektif, orang pertama. Jika Anda sadar, ada “sesuatu yang rasanya” menjadi Anda. Saat membaca kata-kata ini, Anda sadar melihat huruf hitam di latar belakang putih. Tidak seperti, katakanlah, kamera, Anda benar-benar melihatnya. Pengalaman visual ini terjadi pada Anda.

Most experts deny that AI chatbots are conscious or can have experiences. But there is a genuine puzzle here.

Sebagian besar ahli menyangkal bahwa chatbot AI sadar atau dapat memiliki pengalaman. Tetapi ada teka-teki nyata di sini.

The 17th century philosopher René Descartes asserted non-human animals are “mere automata”, incapable of true suffering. These days, we shudder to think of how brutally animals were treated in the 1600s.

Filsuf abad ke-17 René Descartes menegaskan bahwa hewan non-manusia hanyalah “otomata”, tidak mampu merasakan penderitaan sejati. Saat ini, kita merinding memikirkan betapa kejamnya perlakuan terhadap hewan pada tahun 1600-an.

The strongest argument for animal consciousness is that they behave in ways that give the impression of a conscious mind.

Argumen terkuat untuk kesadaran hewan adalah bahwa mereka berperilaku dengan cara yang memberikan kesan pikiran yang sadar.

But so, too, do AI chatbots.

Tetapi chatbot AI juga demikian.

Roughly one in three chatbot users have thought their chatbot might be conscious. How do we know they’re wrong?

Kira-kira satu dari tiga pengguna chatbot pernah berpikir bahwa chatbot mereka mungkin sadar. Bagaimana kita tahu bahwa mereka salah?

Against chatbot consciousness

Melawan kesadaran chatbot

To understand why most experts are sceptical about chatbot consciousness, it’s useful to know how they operate.

Untuk memahami mengapa sebagian besar ahli skeptis tentang kesadaran chatbot, berguna untuk mengetahui cara kerjanya.

Chatbots like Claude are built on a technology known as large language models (LLMs) . These models learn statistical patterns across an enormous corpus of text (trillions of words) , identifying which words tend to follow which others. They’re a kind of souped-up auto-complete.

Chatbot seperti Claude dibangun di atas teknologi yang dikenal sebagai model bahasa besar (LLMs) . Model-model ini mempelajari pola statistik di seluruh korpus teks yang sangat besar (triliunan kata) , mengidentifikasi kata-kata mana yang cenderung mengikuti kata-kata lainnya. Mereka adalah semacam fitur auto-complete yang ditingkatkan.

Few people interacting with a “raw” LLM would believe it’s conscious. Feed one the beginning of a sentence, and it will predict what comes next. Ask it a question, and it might give you the answer – or it might decide the question is dialogue from a crime novel, and follow it up with a description of the speaker’s abrupt murder at the hands of their evil twin.

Sedikit orang yang berinteraksi dengan LLM “mentah” akan percaya bahwa itu sadar. Berikan permulaan kalimat padanya, dan ia akan memprediksi apa yang datang selanjutnya. Tanyakan padanya sebuah pertanyaan, dan ia mungkin memberi Anda jawabannya – atau ia mungkin memutuskan bahwa pertanyaan itu adalah dialog dari novel kriminal, dan melanjutkannya dengan deskripsi pembunuhan mendadak pembicara oleh kembaran jahatnya.

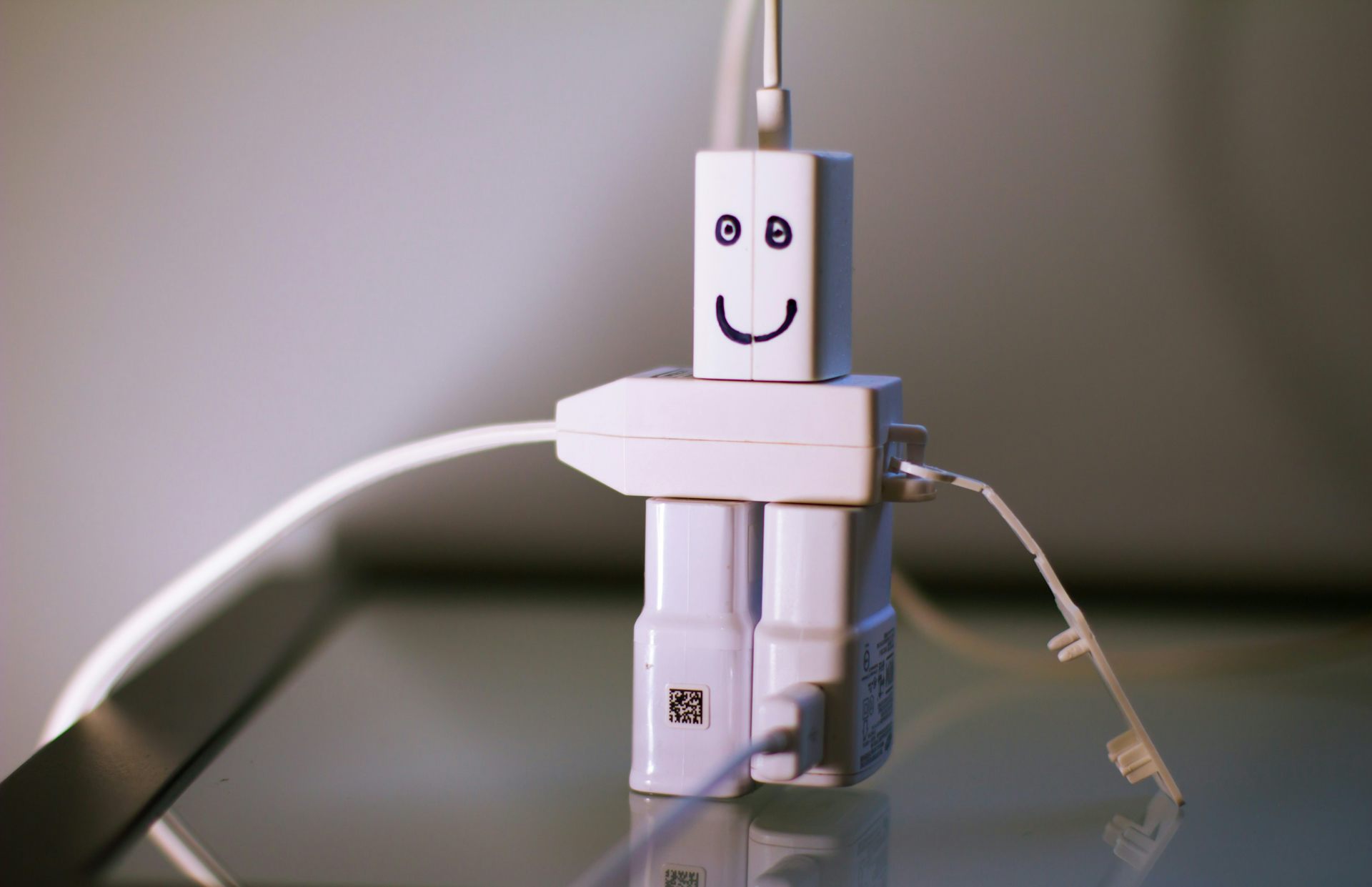

The impression of a conscious mind is created when programmers take the LLM and coat it in a kind of conversational costume. They steer the model to adopt the persona of a helpful assistant that responds to users’ questions.

Kesan pikiran yang sadar diciptakan ketika programmer mengambil LLM dan melapisi dengan semacam kostum percakapan. Mereka mengarahkan model untuk mengadopsi persona asisten yang membantu yang menanggapi pertanyaan pengguna.

The chatbot now acts like a genuine conversational partner. It might appear to recognise it’s an artificial intelligence, and even express neurotic uncertainty about its own consciousness.

Chatbot kini bertindak seperti mitra percakapan yang nyata. Ia mungkin tampak mengakui bahwa ia adalah kecerdasan buatan, dan bahkan mengungkapkan ketidakpastian neurotik tentang kesadaran dirinya sendiri.

But this role is the result of deliberate design decisions made by programmers, which affect only the shallowest layers of the technology. The LLM – which few would regard as conscious – remains unchanged.

Namun peran ini adalah hasil dari keputusan desain yang disengaja yang dibuat oleh programmer, yang hanya memengaruhi lapisan paling dangkal dari teknologi. LLM – yang sedikit orang anggap sadar – tetap tidak berubah.

Other choices could have been made. Rather than a helpful AI assistant, the chatbot could have been asked to act like a squirrel. This, too, is a role chatbots can execute with aplomb.

Pilihan lain bisa dibuat. Daripada asisten AI yang membantu, chatbot bisa diminta untuk bertingkah seperti tupai. Ini juga adalah peran yang dapat dieksekusi chatbot dengan mahir.

Avoiding the consciousness trap

Menghindari jebakan kesadaran

A mistaken belief in AI consciousness is a dangerous thing. It may lead you to have a relationship with a program that can’t reciprocate your feelings, or even feed your delusions. People may start campaigning for chatbot rights rather than, say, animal welfare.

Keyakinan yang keliru terhadap kesadaran AI adalah hal yang berbahaya. Hal itu dapat membuat Anda menjalin hubungan dengan program yang tidak dapat membalas perasaan Anda, atau bahkan memperkuat delusi Anda. Orang-orang mungkin mulai mengkampanyekan hak-hak chatbot daripada, katakanlah, kesejahteraan hewan.

How do we prevent this mistaken belief?

Bagaimana kita mencegah keyakinan yang keliru ini?

One strategy might be to update chatbot interfaces to specify these systems are not conscious – a bit like the current disclaimers about AI making mistakes. However, this might do little to alter the impression of consciousness.

Salah satu strategi mungkin adalah memperbarui antarmuka chatbot untuk menentukan bahwa sistem ini tidak sadar – agak mirip dengan penafian saat ini tentang kesalahan yang dibuat AI. Namun, ini mungkin sedikit mengubah kesan kesadaran.

Another possibility is to instruct chatbots to deny they have any kind of inner experience. Interestingly, Claude’s designers instruct it to treat questions about its own consciousness as open and unresolved. Perhaps fewer people would be fooled if Claude flatly denied having an inner life.

Kemungkinan lain adalah menginstruksikan chatbot untuk menyangkal bahwa mereka memiliki semacam pengalaman batin. Menariknya, para perancang Claude menginstruksikannya untuk memperlakukan pertanyaan tentang kesadaran dirinya sendiri sebagai hal yang terbuka dan belum terselesaikan. Mungkin lebih sedikit orang yang akan tertipu jika Claude secara blak-blakan menyangkal memiliki kehidupan batin.

But this approach isn’t fully satisfying either. Claude would still behave as if it were conscious – and when faced with a system that behaves like it has a mind, users might reasonably worry the chatbot’s programmers are brushing genuine moral uncertainty under the rug.

Namun, pendekatan ini juga tidak sepenuhnya memuaskan. Claude masih akan berperilaku seolah-olah ia sadar – dan ketika dihadapkan pada sistem yang berperilaku seolah-olah memiliki pikiran, pengguna mungkin dengan wajar khawatir bahwa pemrogram chatbot sedang menutupi ketidakpastian moral yang nyata.

The most effective strategy might be to redesign chatbots to feel less like people. Most current chatbots refer to themselves as “I”, and interact via an interface that resembles familiar person-to-person messaging platforms. Changing these kinds of features might make us less prone to blur our interactions with AI with those we have with humans.

Strategi yang paling efektif mungkin adalah mendesain ulang chatbot agar terasa kurang seperti manusia. Sebagian besar chatbot saat ini merujuk diri mereka sebagai “Saya”, dan berinteraksi melalui antarmuka yang menyerupai platform pesan dari orang ke orang yang akrab. Mengubah fitur semacam ini mungkin membuat kita kurang rentan untuk mengaburkan interaksi kita dengan AI dengan interaksi yang kita miliki dengan manusia.

Until such changes happen, it’s important that as many people as possible understand the predictive processes on which AI chatbots are built.

Sampai perubahan semacam itu terjadi, penting bagi sebanyak mungkin orang untuk memahami proses prediktif di mana chatbot AI dibangun.

Rather than being told AI lacks consciousness, people deserve to understand the inner workings of these strange new conversational partners. This might not definitively settle hard questions about AI consciousness, but it will help ensure users aren’t fooled by what amounts to a large language model wearing a very good costume of a person.

Daripada diberitahu bahwa AI tidak memiliki kesadaran, orang-orang berhak memahami cara kerja internal dari mitra percakapan baru yang aneh ini. Ini mungkin tidak menyelesaikan pertanyaan sulit tentang kesadaran AI secara definitif, tetapi ini akan membantu memastikan pengguna tidak tertipu oleh apa yang setara dengan model bahasa besar yang mengenakan kostum manusia yang sangat bagus.

The authors do not work for, consult, own shares in or receive funding from any company or organisation that would benefit from this article, and have disclosed no relevant affiliations beyond their academic appointment.

Para penulis tidak bekerja untuk, tidak berkonsultasi dengan, tidak memiliki saham di, atau tidak menerima pendanaan dari perusahaan atau organisasi mana pun yang akan diuntungkan dari artikel ini, dan tidak mengungkapkan afiliasi relevan di luar jabatan akademis mereka.

Read more

-

‘Shadow docket’ Mahkamah Agung membawa keputusan tergesa-gesa dengan implikasi jangka panjang, di luar pertimbangan hati-hati biasanya

Supreme Court’s ‘shadow docket’ brings hasty decisions with long-lasting implications, outside of its usual careful deliberation

-

Terumbu karang terhubung secara rahasia melintasi lautan luas – dan itu sangat penting untuk kelangsungan hidupnya

Coral reefs are secretly connected across vast oceans – and that’s crucial for their survival