Est-ce que Richard Dawkins a raison concernant Claude ? Non. Mais il n’est pas surprenant que les chatbots IA nous donnent l’impression d’être conscients.

Is Richard Dawkins right about Claude? No. But it’s not surprising AI chatbots feel conscious to us

There are good reasons why we see AI chatbots as more than what they truly are.

Il y a de bonnes raisons pour lesquelles nous considérons les chatbots IA comme étant plus que ce qu’ils sont réellement.

In recent days, evolutionary biologist Richard Dawkins wrote an op-ed suggesting AI chatbot Claude may be conscious.

Ces derniers jours, le biologiste évolutionniste Richard Dawkins a rédigé un éditorial suggérant que le chatbot IA Claude pourrait être conscient.

Dawkins did not express certainty that Claude is conscious. But he pointed out that Claude’s sophisticated abilities are difficult to make sense of without ascribing some kind of inner experience to the machine. The illusion of consciousness – if it is an illusion – is uncannily convincing:

Dawkins n’a pas exprimé d’incertitude quant à la conscience de Claude. Mais il a souligné que les capacités sophistiquées de Claude sont difficiles à comprendre sans attribuer une sorte d’expérience intérieure à la machine. L’illusion de la conscience – si elle en est une – est étrangement convaincante:

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

Si j’ai des soupçons qu’elle n’est peut-être pas consciente, je ne le lui dis pas de peur de la blesser!

Dawkins is not the first to suspect a chatbot of consciousness. In 2022, Blake Lemoine – an engineer at Google – claimed Google’s chatbot LaMDA had interests, and should be used only with the tool’s own consent.

Dawkins n’est pas le premier à soupçonner un chatbot d’être conscient. En 2022, Blake Lemoine, ingénieur chez Google, a affirmé que le chatbot de Google, LaMDA, avait des intérêts et ne devrait être utilisé qu’avec le consentement propre de l’outil.

The history of such claims stretches back all the way to the world’s first chatbot in the mid-1960s. Dubbed Eliza, it followed simple rules that enabled it to ask users about their experiences and beliefs.

L’histoire de telles affirmations remonte au tout premier chatbot au monde au milieu des années 1960. Surnommé Eliza, il suivait des règles simples qui lui permettaient de poser des questions aux utilisateurs sur leurs expériences et leurs croyances.

Many users became emotionally involved with Eliza, sharing intimate thoughts with it and treating it like a person. Eliza’s creator never intended his program to have this effect, and called users’ emotional bonds with the program “powerful delusional thinking”.

De nombreux utilisateurs se sont émotionnellement attachés à Eliza, partageant des pensées intimes avec lui et le traitant comme une personne. Le créateur d’Eliza n’avait jamais voulu que son programme ait cet effet, et a qualifié les liens émotionnels des utilisateurs avec le programme de « puissant raisonnement délirant ».

But is Dawkins really deluded? Why do we see AI chatbots as more than what they truly are, and how do we stop?

Mais Dawkins est-il vraiment délirant? Pourquoi voyons-nous les chatbots IA comme plus que ce qu’ils sont réellement, et comment pouvons-nous arrêter?

The consciousness problem

Le problème de la conscience

Consciousness is widely debated in philosophy, but essentially, it’s the thing that makes subjective, first-person experience possible. If you are conscious, there is “something it is like” to be you. Reading these words, you’re conscious of seeing black letters on a white background. Unlike, say, a camera, you actually see them. This visual experience is happening to you.

La conscience est largement débattue en philosophie, mais essentiellement, c’est ce qui rend possible l’expérience subjective, à la première personne. Si vous êtes conscient, il y a « quelque chose que ça fait » d’être vous. En lisant ces mots, vous êtes conscient de voir des lettres noires sur un fond blanc. Contrairement, par exemple, à un appareil photo, vous les voyez réellement. Cette expérience visuelle vous arrive.

Most experts deny that AI chatbots are conscious or can have experiences. But there is a genuine puzzle here.

La plupart des experts nient que les chatbots IA soient conscients ou puissent avoir des expériences. Mais il y a un véritable mystère ici.

The 17th century philosopher René Descartes asserted non-human animals are “mere automata”, incapable of true suffering. These days, we shudder to think of how brutally animals were treated in the 1600s.

Le philosophe du XVIIe siècle René Descartes a affirmé que les animaux non humains n’étaient que « de simples automates », incapables de souffrir véritablement. Aujourd’hui, nous frissons à l’idée de la brutalité avec laquelle les animaux étaient traités au XVIIe siècle.

The strongest argument for animal consciousness is that they behave in ways that give the impression of a conscious mind.

Le plus fort argument en faveur de la conscience animale est qu’ils se comportent de manière qui donne l’impression d’un esprit conscient.

But so, too, do AI chatbots.

Mais les chatbots IA le font aussi.

Roughly one in three chatbot users have thought their chatbot might be conscious. How do we know they’re wrong?

Environ un utilisateur sur trois de chatbots a pensé que son chatbot pourrait être conscient. Comment savons-nous qu’ils ont tort?

Against chatbot consciousness

Contre la conscience des chatbots

To understand why most experts are sceptical about chatbot consciousness, it’s useful to know how they operate.

Pour comprendre pourquoi la plupart des experts sont sceptiques quant à la conscience des chatbots, il est utile de savoir comment ils fonctionnent.

Chatbots like Claude are built on a technology known as large language models (LLMs) . These models learn statistical patterns across an enormous corpus of text (trillions of words) , identifying which words tend to follow which others. They’re a kind of souped-up auto-complete.

Les chatbots comme Claude sont construits sur une technologie appelée modèles de langage étendus (LLMs) . Ces modèles apprennent des schémas statistiques à partir d’un corpus de texte énorme (des milliers de milliards de mots) , identifiant quels mots ont tendance à suivre quels autres. C’est une sorte d’auto-complétion améliorée.

Few people interacting with a “raw” LLM would believe it’s conscious. Feed one the beginning of a sentence, and it will predict what comes next. Ask it a question, and it might give you the answer – or it might decide the question is dialogue from a crime novel, and follow it up with a description of the speaker’s abrupt murder at the hands of their evil twin.

Peu de personnes interagissant avec un LLM « brut » croiraient qu’il est conscient. Donnez-lui le début d’une phrase, et il prédira ce qui vient ensuite. Posez-lui une question, et il pourrait vous donner la réponse – ou il pourrait décider que la question est un dialogue de roman policier, et la suivre d’une description du meurtre soudain de l’orateur de la main de son jumeau maléfique.

The impression of a conscious mind is created when programmers take the LLM and coat it in a kind of conversational costume. They steer the model to adopt the persona of a helpful assistant that responds to users’ questions.

L’impression d’un esprit conscient est créée lorsque les programmeurs prennent le LLM et le revêtent d’une sorte de costume conversationnel. Ils orientent le modèle pour qu’il adopte la personnalité d’un assistant serviable qui répond aux questions des utilisateurs.

The chatbot now acts like a genuine conversational partner. It might appear to recognise it’s an artificial intelligence, and even express neurotic uncertainty about its own consciousness.

Le chatbot agit maintenant comme un véritable partenaire de conversation. Il pourrait sembler reconnaître qu’il s’agit d’une intelligence artificielle, et même exprimer une incertitude névrotique quant à sa propre conscience.

But this role is the result of deliberate design decisions made by programmers, which affect only the shallowest layers of the technology. The LLM – which few would regard as conscious – remains unchanged.

Mais ce rôle est le résultat de décisions de conception délibérées prises par les programmeurs, qui n’affectent que les couches les plus superficielles de la technologie. Le LLM – que peu considéreraient comme conscient – reste inchangé.

Other choices could have been made. Rather than a helpful AI assistant, the chatbot could have been asked to act like a squirrel. This, too, is a role chatbots can execute with aplomb.

D’autres choix auraient pu être faits. Au lieu d’un assistant IA serviable, le chatbot aurait pu être chargé d’agir comme un écureuil. C’est également un rôle que les chatbots peuvent exécuter avec aplomb.

Avoiding the consciousness trap

Éviter le piège de la conscience

A mistaken belief in AI consciousness is a dangerous thing. It may lead you to have a relationship with a program that can’t reciprocate your feelings, or even feed your delusions. People may start campaigning for chatbot rights rather than, say, animal welfare.

Croire à la conscience de l’IA est dangereux. Cela peut vous amener à nouer une relation avec un programme qui ne peut pas rendre vos sentiments, ou même alimenter vos illusions. Les gens pourraient commencer à militer pour les droits des chatbots plutôt que, par exemple, pour le bien-être animal.

How do we prevent this mistaken belief?

Comment prévenir cette fausse croyance?

One strategy might be to update chatbot interfaces to specify these systems are not conscious – a bit like the current disclaimers about AI making mistakes. However, this might do little to alter the impression of consciousness.

Une stratégie pourrait être de mettre à jour les interfaces des chatbots pour spécifier que ces systèmes ne sont pas conscients – un peu comme les clauses de non-responsabilité actuelles concernant les erreurs de l’IA. Cependant, cela pourrait peu altérer l’impression de conscience.

Another possibility is to instruct chatbots to deny they have any kind of inner experience. Interestingly, Claude’s designers instruct it to treat questions about its own consciousness as open and unresolved. Perhaps fewer people would be fooled if Claude flatly denied having an inner life.

Une autre possibilité est d’instruire les chatbots de nier avoir une quelconque expérience intérieure. Fait intéressant, les concepteurs de Claude lui demandent de traiter les questions sur sa propre conscience comme ouvertes et non résolues. Peut-être que moins de gens seraient dupés si Claude niait catégoriquement avoir une vie intérieure.

But this approach isn’t fully satisfying either. Claude would still behave as if it were conscious – and when faced with a system that behaves like it has a mind, users might reasonably worry the chatbot’s programmers are brushing genuine moral uncertainty under the rug.

Mais cette approche n’est pas non plus entièrement satisfaisante. Claude se comporterait toujours comme s’il était conscient – et face un système qui se comporte comme s’il avait un esprit, les utilisateurs pourraient raisonnablement craindre que les programmeurs du chatbot ne balayent sous le tapis une incertitude morale réelle.

The most effective strategy might be to redesign chatbots to feel less like people. Most current chatbots refer to themselves as “I”, and interact via an interface that resembles familiar person-to-person messaging platforms. Changing these kinds of features might make us less prone to blur our interactions with AI with those we have with humans.

La stratégie la plus efficace pourrait être de repenser les chatbots pour qu’ils ressemblent moins à des personnes. La plupart des chatbots actuels se réfèrent à eux-mêmes à la première personne (« Je ») et interagissent via une interface qui ressemble à des plateformes de messagerie personnelle familières. Changer ce genre de fonctionnalités pourrait nous rendre moins enclins à brouiller nos interactions avec l’IA et celles que nous avons avec les humains.

Until such changes happen, it’s important that as many people as possible understand the predictive processes on which AI chatbots are built.

Tant que de tels changements n’auront pas lieu, il est important que le plus grand nombre de personnes possible comprennent les processus prédictifs sur lesquels sont construits les chatbots IA.

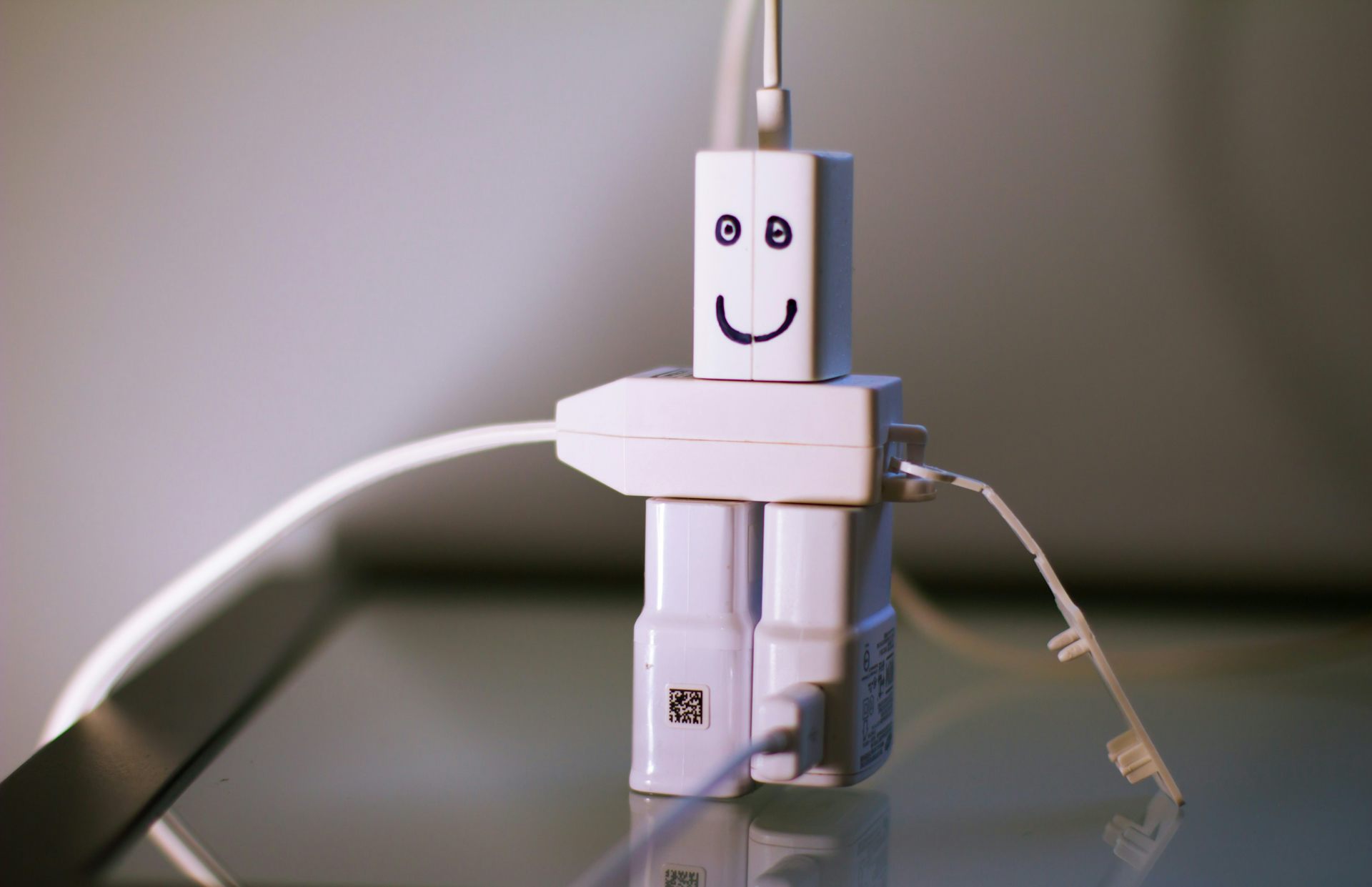

Rather than being told AI lacks consciousness, people deserve to understand the inner workings of these strange new conversational partners. This might not definitively settle hard questions about AI consciousness, but it will help ensure users aren’t fooled by what amounts to a large language model wearing a very good costume of a person.

Plutôt que de nous dire que l’IA manque de conscience, les gens méritent de comprendre le fonctionnement interne de ces nouveaux partenaires conversationnels étranges. Cela ne réglera peut-être pas définitivement les questions complexes sur la conscience de l’IA, mais cela aidera à garantir que les utilisateurs ne sont pas trompés par ce qui équivaut à un grand modèle linguistique portant un très bon costume de personne.

The authors do not work for, consult, own shares in or receive funding from any company or organisation that would benefit from this article, and have disclosed no relevant affiliations beyond their academic appointment.

Les auteurs ne travaillent pour, ne consultent, ne détiennent pas d’actions ni ne reçoivent de financement de la part d’aucune entreprise ou organisation qui bénéficierait de cet article, et n’ont divulgué aucune affiliation pertinente au-delà de leur nomination universitaire.

Read more

-

Comment 2 hommes ont fracassé une barrière marathon longtemps considérée comme incassable

How 2 men smashed through a marathon barrier long thought unbreakable

-

Les résultats de notre Grand collisionneur de hadrons suggèrent une physique non découverte

Our Large Hadron Collider results hint at undiscovered physics