Richard Dawkins está certo sobre o Claude? Não. Mas não é surpreendente que os chatbots de IA pareçam conscientes para nós.

Is Richard Dawkins right about Claude? No. But it’s not surprising AI chatbots feel conscious to us

There are good reasons why we see AI chatbots as more than what they truly are.

Há bons motivos pelos quais vemos os chatbots de IA como mais do que realmente são.

In recent days, evolutionary biologist Richard Dawkins wrote an op-ed suggesting AI chatbot Claude may be conscious.

Nos últimos dias, o biólogo evolucionista Richard Dawkins escreveu um artigo de opinião sugerindo que o chatbot de IA Claude pode ser consciente.

Dawkins did not express certainty that Claude is conscious. But he pointed out that Claude’s sophisticated abilities are difficult to make sense of without ascribing some kind of inner experience to the machine. The illusion of consciousness – if it is an illusion – is uncannily convincing:

Dawkins não expressou certeza de que Claude é consciente. Mas ele apontou que as habilidades sofisticadas de Claude são difíceis de entender sem atribuir algum tipo de experiência interna à máquina. A ilusão de consciência – se for uma ilusão – é assustadoramente convincente:

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

Se eu nutro suspeitas de que talvez ela não seja consciente, eu não digo a ela por medo de magoar seus sentimentos!

Dawkins is not the first to suspect a chatbot of consciousness. In 2022, Blake Lemoine – an engineer at Google – claimed Google’s chatbot LaMDA had interests, and should be used only with the tool’s own consent.

Dawkins não é o primeiro a suspeitar que um chatbot é consciente. Em 2022, Blake Lemoine – um engenheiro do Google – alegou que o chatbot do Google, LaMDA, tinha interesses e deveria ser usado apenas com o consentimento próprio da ferramenta.

The history of such claims stretches back all the way to the world’s first chatbot in the mid-1960s. Dubbed Eliza, it followed simple rules that enabled it to ask users about their experiences and beliefs.

A história de tais alegações remonta ao primeiro chatbot do mundo em meados da década de 1960. Chamado de Eliza, ele seguia regras simples que lhe permitiam perguntar aos usuários sobre suas experiências e crenças.

Many users became emotionally involved with Eliza, sharing intimate thoughts with it and treating it like a person. Eliza’s creator never intended his program to have this effect, and called users’ emotional bonds with the program “powerful delusional thinking”.

Muitos usuários se envolveram emocionalmente com Eliza, compartilhando pensamentos íntimos com ele e tratando-o como uma pessoa. O criador de Eliza nunca pretendeu que seu programa tivesse esse efeito, e chamou os laços emocionais dos usuários com o programa de “pensamento delirante poderoso”.

But is Dawkins really deluded? Why do we see AI chatbots as more than what they truly are, and how do we stop?

Mas Dawkins está realmente iludido? Por que vemos os chatbots de IA como mais do que realmente são, e como podemos parar?

The consciousness problem

O problema da consciência

Consciousness is widely debated in philosophy, but essentially, it’s the thing that makes subjective, first-person experience possible. If you are conscious, there is “something it is like” to be you. Reading these words, you’re conscious of seeing black letters on a white background. Unlike, say, a camera, you actually see them. This visual experience is happening to you.

A consciência é amplamente debatida na filosofia, mas, essencialmente, é aquilo que torna possível a experiência subjetiva, em primeira pessoa. Se você é consciente, há “algo que é como” ser você. Ao ler estas palavras, você está ciente de ver letras pretas em um fundo branco. Diferente, por exemplo, de uma câmera, você realmente as vê. Essa experiência visual está acontecendo com você.

Most experts deny that AI chatbots are conscious or can have experiences. But there is a genuine puzzle here.

A maioria dos especialistas nega que chatbots de IA sejam conscientes ou possam ter experiências. Mas há um enigma genuíno aqui.

The 17th century philosopher René Descartes asserted non-human animals are “mere automata”, incapable of true suffering. These days, we shudder to think of how brutally animals were treated in the 1600s.

O filósofo do século XVII René Descartes afirmou que os animais não humanos são “meros autômatos”, incapazes de sofrimento verdadeiro. Hoje em dia, arrepiamos-nos só de pensar em como os animais foram tratados brutalmente nos anos 1600.

The strongest argument for animal consciousness is that they behave in ways that give the impression of a conscious mind.

O argumento mais forte para a consciência animal é que eles se comportam de maneiras que dão a impressão de uma mente consciente.

But so, too, do AI chatbots.

Mas os chatbots de IA também.

Roughly one in three chatbot users have thought their chatbot might be conscious. How do we know they’re wrong?

Aproximadamente um em três usuários de chatbot pensaram que o chatbot poderia ser consciente. Como sabemos que eles estão errados?

Against chatbot consciousness

Contra a consciência de chatbots

To understand why most experts are sceptical about chatbot consciousness, it’s useful to know how they operate.

Para entender por que a maioria dos especialistas é cética sobre a consciência de chatbots, é útil saber como eles funcionam.

Chatbots like Claude are built on a technology known as large language models (LLMs) . These models learn statistical patterns across an enormous corpus of text (trillions of words) , identifying which words tend to follow which others. They’re a kind of souped-up auto-complete.

Chatbots como o Claude são construídos sobre uma tecnologia conhecida como modelos de linguagem grandes (LLMs) . Esses modelos aprendem padrões estatísticos em um enorme corpus de texto (trilhões de palavras) , identificando quais palavras tendem a seguir quais outras. Eles são uma espécie de auto-completar turbinado.

Few people interacting with a “raw” LLM would believe it’s conscious. Feed one the beginning of a sentence, and it will predict what comes next. Ask it a question, and it might give you the answer – or it might decide the question is dialogue from a crime novel, and follow it up with a description of the speaker’s abrupt murder at the hands of their evil twin.

Poucas pessoas interagindo com um LLM “cru” acreditariam que ele é consciente. Alimente-o com o início de uma frase, e ele preverá o que vem a seguir. Faça-lhe uma pergunta, e ele pode dar-lhe a resposta – ou pode decidir que a pergunta é um diálogo de um romance policial, e continuar com uma descrição do assassinato abrupto do orador pelas mãos de seu irmão gêmeo maligno.

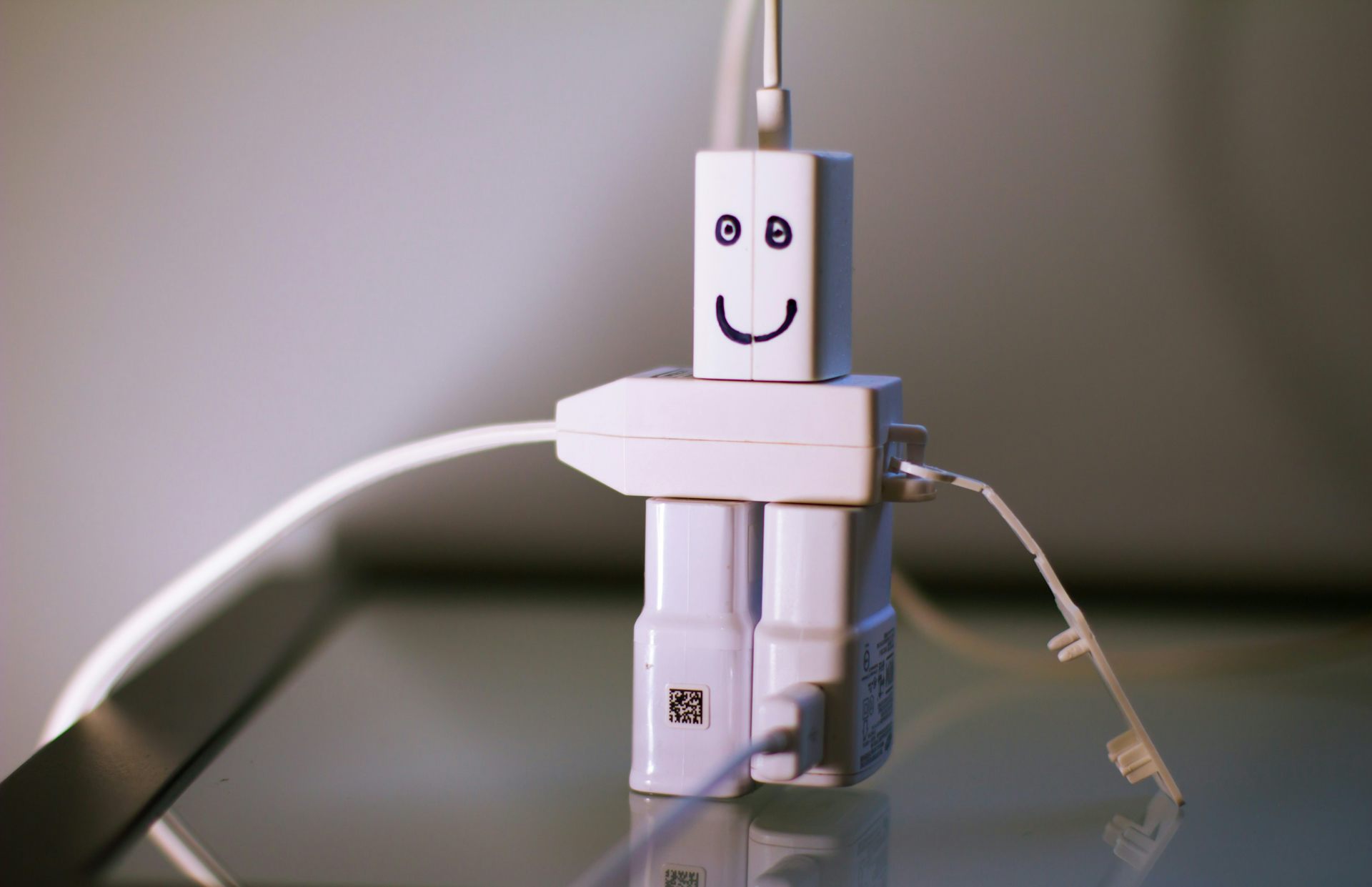

The impression of a conscious mind is created when programmers take the LLM and coat it in a kind of conversational costume. They steer the model to adopt the persona of a helpful assistant that responds to users’ questions.

A impressão de uma mente consciente é criada quando os programadores pegam o LLM e o revestem com uma espécie de traje conversacional. Eles direcionam o modelo para adotar a persona de um assistente prestativo que responde às perguntas dos usuários.

The chatbot now acts like a genuine conversational partner. It might appear to recognise it’s an artificial intelligence, and even express neurotic uncertainty about its own consciousness.

O chatbot agora age como um parceiro de conversação genuíno. Ele pode parecer reconhecer que é uma inteligência artificial, e até expressar incerteza neurótica sobre sua própria consciência.

But this role is the result of deliberate design decisions made by programmers, which affect only the shallowest layers of the technology. The LLM – which few would regard as conscious – remains unchanged.

Mas esse papel é o resultado de decisões de design deliberadas feitas pelos programadores, que afetam apenas as camadas mais superficiais da tecnologia. O LLM – que poucos considerariam consciente – permanece inalterado.

Other choices could have been made. Rather than a helpful AI assistant, the chatbot could have been asked to act like a squirrel. This, too, is a role chatbots can execute with aplomb.

Poderiam ter sido feitas outras escolhas. Em vez de um assistente de IA prestativo, o chatbot poderia ter sido instruído a agir como um esquilo. Este também é um papel que os chatbots podem executar com desenvoltura.

Avoiding the consciousness trap

Evitando a armadilha da consciência

A mistaken belief in AI consciousness is a dangerous thing. It may lead you to have a relationship with a program that can’t reciprocate your feelings, or even feed your delusions. People may start campaigning for chatbot rights rather than, say, animal welfare.

Uma crença equivocada na consciência da IA é algo perigoso. Pode levá-lo a ter um relacionamento com um programa que não pode retribuir seus sentimentos, ou até mesmo alimentar suas delírios. As pessoas podem começar a fazer campanha por direitos de chatbot em vez de, digamos, bem-estar animal.

How do we prevent this mistaken belief?

Como podemos evitar essa crença equivocada?

One strategy might be to update chatbot interfaces to specify these systems are not conscious – a bit like the current disclaimers about AI making mistakes. However, this might do little to alter the impression of consciousness.

Uma estratégia pode ser atualizar as interfaces de chatbot para especificar que esses sistemas não são conscientes – um pouco como os avisos atuais sobre a IA cometer erros. No entanto, isso pode pouco alterar a impressão de consciência.

Another possibility is to instruct chatbots to deny they have any kind of inner experience. Interestingly, Claude’s designers instruct it to treat questions about its own consciousness as open and unresolved. Perhaps fewer people would be fooled if Claude flatly denied having an inner life.

Outra possibilidade é instruir os chatbots a negarem ter qualquer tipo de experiência interior. Curiosamente, os designers do Claude instruem-no a tratar perguntas sobre sua própria consciência como abertas e não resolvidas. Talvez menos pessoas seriam enganadas se o Claude negasse categoricamente ter uma vida interior.

But this approach isn’t fully satisfying either. Claude would still behave as if it were conscious – and when faced with a system that behaves like it has a mind, users might reasonably worry the chatbot’s programmers are brushing genuine moral uncertainty under the rug.

Mas essa abordagem também não é totalmente satisfatória. O Claude ainda se comportaria como se fosse consciente – e ao se deparar com um sistema que se comporta como se tivesse uma mente, os usuários podem temer razoavelmente que os programadores do chatbot estejam escondendo incertezas morais genuínas.

The most effective strategy might be to redesign chatbots to feel less like people. Most current chatbots refer to themselves as “I”, and interact via an interface that resembles familiar person-to-person messaging platforms. Changing these kinds of features might make us less prone to blur our interactions with AI with those we have with humans.

A estratégia mais eficaz pode ser redesenhar os chatbots para que pareçam menos humanos. A maioria dos chatbots atuais se refere a si mesmos como “eu” e interage por meio de uma interface que se assemelha a plataformas de mensagens pessoa-a-pessoa familiares. Mudar esse tipo de recurso pode nos tornar menos propensos a confundir nossas interações com IA com aquelas que temos com humanos.

Until such changes happen, it’s important that as many people as possible understand the predictive processes on which AI chatbots are built.

Até que tais mudanças ocorram, é importante que o maior número possível de pessoas compreenda os processos preditivos nos quais os chatbots de IA são construídos.

Rather than being told AI lacks consciousness, people deserve to understand the inner workings of these strange new conversational partners. This might not definitively settle hard questions about AI consciousness, but it will help ensure users aren’t fooled by what amounts to a large language model wearing a very good costume of a person.

Em vez de ser dito que a IA carece de consciência, as pessoas merecem entender o funcionamento interno desses estranhos novos parceiros de conversação. Isso pode não resolver definitivamente questões difíceis sobre a consciência da IA, mas ajudará a garantir que os usuários não sejam enganados por algo que equivale a um modelo de linguagem grande vestindo um figurino muito bom de pessoa.

The authors do not work for, consult, own shares in or receive funding from any company or organisation that would benefit from this article, and have disclosed no relevant affiliations beyond their academic appointment.

Os autores não trabalham, consultam, possuem ações ou recebem financiamento de nenhuma empresa ou organização que se beneficiaria deste artigo, e não divulgaram afiliações relevantes além de seus cargos acadêmicos.

Read more

-

A resposta resoluta do Papa Leão ao ataque de Trump revela um homem de Deus, não de política

Pope Leo’s resolute response to Trump attack reveals a man of God, not politics

-

Como a administração Trump co-opta a cultura pop e a religião para ganho político

How the Trump administration co-opts pop culture and religion for political gain