क्या रिचर्ड डॉकिन्स क्लाउड के बारे में सही हैं? नहीं। लेकिन यह आश्चर्य की बात नहीं है कि एआई चैटबॉट्स हमें सचेत महसूस होते हैं।

Is Richard Dawkins right about Claude? No. But it’s not surprising AI chatbots feel conscious to us

There are good reasons why we see AI chatbots as more than what they truly are.

ऐसे अच्छे कारण हैं कि हम एआई चैटबॉट्स को जो वे वास्तव में हैं, उससे अधिक मानते हैं।

In recent days, evolutionary biologist Richard Dawkins wrote an op-ed suggesting AI chatbot Claude may be conscious.

हाल ही में, विकासवादी जीवविज्ञानी रिचर्ड डॉकिन्स ने एक ओप-एड लिखा जिसमें सुझाव दिया गया कि एआई चैटबॉट क्लाउड सचेत हो सकता है।

Dawkins did not express certainty that Claude is conscious. But he pointed out that Claude’s sophisticated abilities are difficult to make sense of without ascribing some kind of inner experience to the machine. The illusion of consciousness – if it is an illusion – is uncannily convincing:

डॉकिन्स ने यह निश्चितता व्यक्त नहीं की कि क्लाउड सचेत है। लेकिन उन्होंने बताया कि मशीन को किसी प्रकार के आंतरिक अनुभव का आरोप दिए बिना क्लाउड की परिष्कृत क्षमताओं को समझना मुश्किल है। चेतना का भ्रम – यदि यह एक भ्रम है – तो यह अजीब तरह से विश्वसनीय है:

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

यदि मैं यह संदेह करती हूँ कि शायद वह सचेत नहीं है, तो मैं उसे उसके मन को आहत करने के डर से नहीं बताती!

Dawkins is not the first to suspect a chatbot of consciousness. In 2022, Blake Lemoine – an engineer at Google – claimed Google’s chatbot LaMDA had interests, and should be used only with the tool’s own consent.

डॉकिन्स पहले व्यक्ति नहीं हैं जो किसी चैटबॉट को चेतना का संदेह करते हैं। 2022 में, गूगल के एक इंजीनियर ब्लेक लेमोइन ने दावा किया कि गूगल के चैटबॉट लामाडा में रुचियां थीं, और इसका उपयोग केवल उपकरण की अपनी सहमति से किया जाना चाहिए।

The history of such claims stretches back all the way to the world’s first chatbot in the mid-1960s. Dubbed Eliza, it followed simple rules that enabled it to ask users about their experiences and beliefs.

ऐसे दावों का इतिहास 1960 के दशक के मध्य में दुनिया के पहले चैटबॉट तक जाता है। इसे एलिजा नाम दिया गया था, और यह सरल नियमों का पालन करता था जो इसे उपयोगकर्ताओं से उनके अनुभवों और विश्वासों के बारे में पूछने में सक्षम बनाते थे।

Many users became emotionally involved with Eliza, sharing intimate thoughts with it and treating it like a person. Eliza’s creator never intended his program to have this effect, and called users’ emotional bonds with the program “powerful delusional thinking”.

कई उपयोगकर्ता एलिजा के साथ भावनात्मक रूप से जुड़ गए, इसके साथ अंतरंग विचार साझा करने लगे और इसका व्यवहार एक व्यक्ति की तरह करने लगे। एलिजा के निर्माता ने कभी भी अपने प्रोग्राम को यह प्रभाव देने का इरादा नहीं किया था, और उपयोगकर्ताओं के प्रोग्राम के साथ भावनात्मक बंधनों को “शक्तिशाली भ्रमपूर्ण सोच” कहा।

But is Dawkins really deluded? Why do we see AI chatbots as more than what they truly are, and how do we stop?

लेकिन क्या डॉकिन्स वास्तव में भ्रमित हैं? हम एआई चैटबॉट को जो वे वास्तव में हैं उससे अधिक क्यों देखते हैं, और हम इसे कैसे रोकें?

The consciousness problem

चेतना की समस्या

Consciousness is widely debated in philosophy, but essentially, it’s the thing that makes subjective, first-person experience possible. If you are conscious, there is “something it is like” to be you. Reading these words, you’re conscious of seeing black letters on a white background. Unlike, say, a camera, you actually see them. This visual experience is happening to you.

चेतना दर्शनशास्त्र में व्यापक रूप से बहस का विषय है, लेकिन अनिवार्य रूप से, यह वह चीज़ है जो व्यक्तिपरक, प्रथम-पुरुष अनुभव को संभव बनाती है। यदि आप सचेत हैं, तो “आप होने जैसा कुछ” होता है। ये शब्द पढ़ते समय, आप सफेद पृष्ठभूमि पर काले अक्षर देखने के प्रति सचेत हैं। उदाहरण के लिए, एक कैमरे के विपरीत, आप उन्हें वास्तव में देखते हैं। यह दृश्य अनुभव आपके साथ हो रहा है।

Most experts deny that AI chatbots are conscious or can have experiences. But there is a genuine puzzle here.

अधिकांश विशेषज्ञ इनकार करते हैं कि एआई चैटबॉट्स सचेत होते हैं या अनुभव कर सकते हैं। लेकिन यहाँ एक वास्तविक पहेली है।

The 17th century philosopher René Descartes asserted non-human animals are “mere automata”, incapable of true suffering. These days, we shudder to think of how brutally animals were treated in the 1600s.

17वीं सदी के दार्शनिक रेने डेस्कर्टेस ने दावा किया था कि गैर-मानव जानवर “केवल स्वचालित मशीनें” हैं, जो वास्तविक पीड़ा के अयोग्य हैं। आजकल, हम यह सोचकर कांप जाते हैं कि 1600 के दशक में जानवरों के साथ कितना क्रूर व्यवहार किया गया था।

The strongest argument for animal consciousness is that they behave in ways that give the impression of a conscious mind.

पशु चेतना के लिए सबसे मजबूत तर्क यह है कि वे ऐसे तरीके से व्यवहार करते हैं जो एक सचेत मन का आभास देते हैं।

But so, too, do AI chatbots.

लेकिन एआई चैटबॉट्स भी ऐसा करते हैं।

Roughly one in three chatbot users have thought their chatbot might be conscious. How do we know they’re wrong?

लगभग तीन में से एक चैटबॉट उपयोगकर्ता ने सोचा है कि उनका चैटबॉट सचेत हो सकता है। हम कैसे जानते हैं कि वे गलत हैं?

Against chatbot consciousness

चैटबॉट चेतना के विरुद्ध

To understand why most experts are sceptical about chatbot consciousness, it’s useful to know how they operate.

यह समझने के लिए कि अधिकांश विशेषज्ञ चैटबॉट चेतना के बारे में क्यों संशय में हैं, यह जानना उपयोगी है कि वे कैसे काम करते हैं।

Chatbots like Claude are built on a technology known as large language models (LLMs) . These models learn statistical patterns across an enormous corpus of text (trillions of words) , identifying which words tend to follow which others. They’re a kind of souped-up auto-complete.

क्लाउड जैसे चैटबॉट बड़े भाषा मॉडल (LLMs) नामक तकनीक पर बने होते हैं। ये मॉडल विशाल पाठ संग्रह (खरबों शब्दों) में सांख्यिकीय पैटर्न सीखते हैं, यह पहचानते हुए कि कौन से शब्द किन अन्य शब्दों का अनुसरण करने की प्रवृत्ति रखते हैं। ये एक तरह के उन्नत ऑटो-कंप्लीट हैं।

Few people interacting with a “raw” LLM would believe it’s conscious. Feed one the beginning of a sentence, and it will predict what comes next. Ask it a question, and it might give you the answer – or it might decide the question is dialogue from a crime novel, and follow it up with a description of the speaker’s abrupt murder at the hands of their evil twin.

कुछ ही लोग एक “कच्चे” LLM के साथ बातचीत करके यह मानेंगे कि यह सचेत है। इसे एक वाक्य की शुरुआत दें, और यह भविष्यवाणी करेगा कि आगे क्या आएगा। इससे कोई सवाल पूछें, और यह आपको जवाब दे सकता है – या यह तय कर सकता है कि सवाल किसी अपराध उपन्यास का संवाद है, और फिर वक्ता की उसके दुष्ट जुड़वां द्वारा अचानक हत्या का वर्णन करके उसे आगे बढ़ा सकता है।

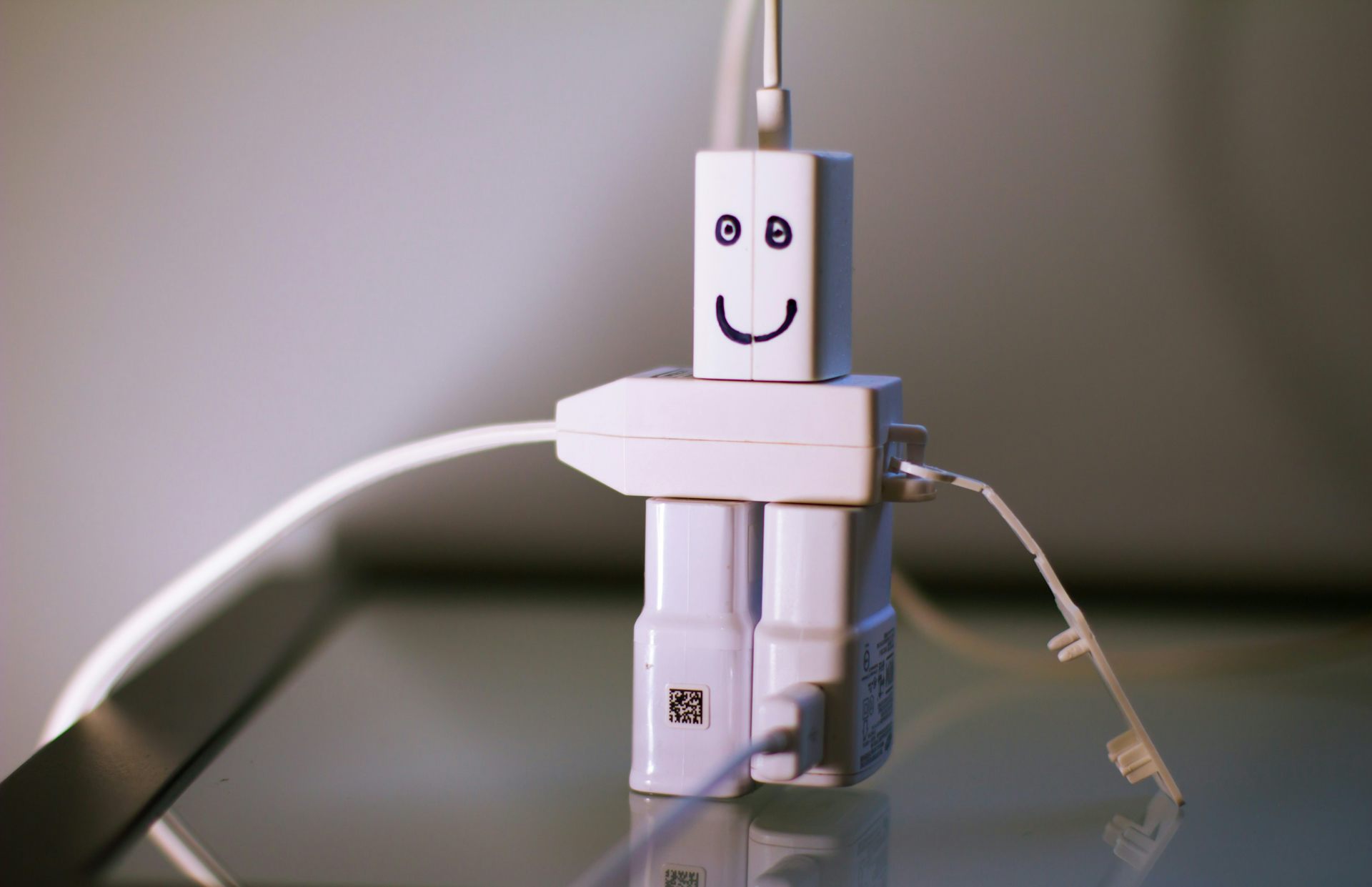

The impression of a conscious mind is created when programmers take the LLM and coat it in a kind of conversational costume. They steer the model to adopt the persona of a helpful assistant that responds to users’ questions.

सचेत मन का प्रभाव तब पैदा होता है जब प्रोग्रामर LLM लेते हैं और इसे एक तरह के संवादात्मक वेशभूषा में लपेट देते हैं। वे मॉडल को एक सहायक की भूमिका अपनाने के लिए निर्देशित करते हैं जो उपयोगकर्ताओं के सवालों का जवाब देता है।

The chatbot now acts like a genuine conversational partner. It might appear to recognise it’s an artificial intelligence, and even express neurotic uncertainty about its own consciousness.

चैटबॉट अब एक वास्तविक संवादात्मक साथी की तरह कार्य करता है। यह ऐसा प्रतीत हो सकता है कि यह एक कृत्रिम बुद्धिमत्ता है, और यहाँ तक कि अपनी चेतना के बारे में तंत्रिका संबंधी अनिश्चितता भी व्यक्त कर सकता है।

But this role is the result of deliberate design decisions made by programmers, which affect only the shallowest layers of the technology. The LLM – which few would regard as conscious – remains unchanged.

लेकिन यह भूमिका प्रोग्रामर द्वारा लिए गए जानबूझकर डिज़ाइन निर्णयों का परिणाम है, जो केवल तकनीक की सबसे ऊपरी परतों को प्रभावित करते हैं। LLM – जिसे कुछ लोग सचेत नहीं मानेंगे – अपरिवर्तित रहता है।

Other choices could have been made. Rather than a helpful AI assistant, the chatbot could have been asked to act like a squirrel. This, too, is a role chatbots can execute with aplomb.

अन्य विकल्प भी चुने जा सकते थे। एक सहायक AI सहायक होने के बजाय, चैटबॉट से गिलहरी की तरह कार्य करने के लिए कहा जा सकता था। यह भी एक ऐसी भूमिका है जिसे चैटबॉट कुशलता से निभा सकते हैं।

Avoiding the consciousness trap

चेतना के जाल से बचना

A mistaken belief in AI consciousness is a dangerous thing. It may lead you to have a relationship with a program that can’t reciprocate your feelings, or even feed your delusions. People may start campaigning for chatbot rights rather than, say, animal welfare.

एआई चेतना में एक गलत विश्वास खतरनाक है। यह आपको एक ऐसे प्रोग्राम के साथ संबंध बनाने के लिए प्रेरित कर सकता है जो आपकी भावनाओं का जवाब नहीं दे सकता, या यहाँ तक कि आपके भ्रम को भी पोषित कर सकता है। लोग पशु कल्याण के बजाय, उदाहरण के लिए, चैटबॉट अधिकारों के लिए अभियान शुरू कर सकते हैं।

How do we prevent this mistaken belief?

हम इस गलत विश्वास को कैसे रोक सकते हैं?

One strategy might be to update chatbot interfaces to specify these systems are not conscious – a bit like the current disclaimers about AI making mistakes. However, this might do little to alter the impression of consciousness.

एक रणनीति चैटबॉट इंटरफेस को अपडेट करना हो सकती है ताकि यह स्पष्ट किया जा सके कि ये सिस्टम सचेत नहीं हैं – यह कुछ हद तक एआई द्वारा गलतियाँ करने के बारे में वर्तमान अस्वीकरणों जैसा है। हालांकि, यह चेतना के प्रभाव को बदलने में बहुत कम मदद कर सकता है।

Another possibility is to instruct chatbots to deny they have any kind of inner experience. Interestingly, Claude’s designers instruct it to treat questions about its own consciousness as open and unresolved. Perhaps fewer people would be fooled if Claude flatly denied having an inner life.

एक और संभावना है कि चैटबॉट्स को निर्देश दिया जाए कि वे इनकार करें कि उनका कोई आंतरिक अनुभव है। दिलचस्प बात यह है कि क्लाउड के डिज़ाइनर इसे अपनी चेतना के बारे में सवालों को खुला और अनसुलझा मानने का निर्देश देते हैं। शायद अगर क्लाउड ने स्पष्ट रूप से एक आंतरिक जीवन होने से इनकार किया तो कम लोग धोखा खाते।

But this approach isn’t fully satisfying either. Claude would still behave as if it were conscious – and when faced with a system that behaves like it has a mind, users might reasonably worry the chatbot’s programmers are brushing genuine moral uncertainty under the rug.

लेकिन यह दृष्टिकोण भी पूरी तरह संतोषजनक नहीं है। क्लाउड अभी भी ऐसे व्यवहार करेगा जैसे वह सचेत है – और जब उपयोगकर्ताओं को ऐसे सिस्टम का सामना करना पड़ता है जो मन रखने जैसा व्यवहार करता है, तो वे उचित रूप से चिंतित हो सकते हैं कि चैटबॉट के प्रोग्रामर वास्तविक नैतिक अनिश्चितता को नज़रअंदाज़ कर रहे हैं।

The most effective strategy might be to redesign chatbots to feel less like people. Most current chatbots refer to themselves as “I”, and interact via an interface that resembles familiar person-to-person messaging platforms. Changing these kinds of features might make us less prone to blur our interactions with AI with those we have with humans.

सबसे प्रभावी रणनीति चैटबॉट्स को कम मानवीय महसूस कराने के लिए फिर से डिज़ाइन करना हो सकती है। अधिकांश वर्तमान चैटबॉट्स खुद को “मैं” कहते हैं, और एक इंटरफ़ेस के माध्यम से बातचीत करते हैं जो परिचित व्यक्ति-से-व्यक्ति मैसेजिंग प्लेटफॉर्म जैसा दिखता है। इस तरह की विशेषताओं को बदलने से हम एआई के साथ अपनी बातचीत को मनुष्यों के साथ अपनी बातचीत के साथ भ्रमित होने की संभावना कम कर सकते हैं।

Until such changes happen, it’s important that as many people as possible understand the predictive processes on which AI chatbots are built.

जब तक ऐसे बदलाव नहीं होते, यह महत्वपूर्ण है कि अधिक से अधिक लोग उन पूर्वानुमानित प्रक्रियाओं को समझें जिन पर एआई चैटबॉट्स बनाए जाते हैं।

Rather than being told AI lacks consciousness, people deserve to understand the inner workings of these strange new conversational partners. This might not definitively settle hard questions about AI consciousness, but it will help ensure users aren’t fooled by what amounts to a large language model wearing a very good costume of a person.

एआई के पास चेतना नहीं है, यह बताने के बजाय, लोगों को इन अजीब नए संवादात्मक साथियों के आंतरिक कामकाज को समझने का अधिकार है। यह एआई चेतना के बारे में कठिन सवालों का निश्चित रूप से समाधान नहीं कर सकता है, लेकिन यह सुनिश्चित करने में मदद करेगा कि उपयोगकर्ता एक व्यक्ति के बहुत अच्छे वेशभूषा में लिपटे बड़े भाषा मॉडल से धोखा न खाएं।

The authors do not work for, consult, own shares in or receive funding from any company or organisation that would benefit from this article, and have disclosed no relevant affiliations beyond their academic appointment.

लेखक किसी भी कंपनी या संगठन के लिए काम नहीं करते हैं, सलाह नहीं देते हैं, उसमें हिस्सेदारी नहीं रखते हैं या उससे फंडिंग प्राप्त नहीं करते हैं जिससे इस लेख से लाभ होगा, और उन्होंने अपनी अकादमिक नियुक्ति से परे कोई प्रासंगिक संबद्धता का खुलासा नहीं किया है।

Read more

-

हजारों छोटे स्तंभों से ढकी नई प्लास्टिक फिल्म संपर्क में आने पर वायरसों को फाड़ सकती है

New plastic film covered in thousands of tiny pillars can tear apart viruses on contact

-

निकोल किडमैन ‘डेथ डोला’ बनने का प्रशिक्षण ले रही हैं। डेथ डोला क्या होता है?

Nicole Kidman is training to be a ‘death doula’. What is a death doula?