هل ريتشارد دوكنز محق بشأن كلود؟ لا. لكن ليس من المستغرب أن تشعرنا روبوتات الدردشة بالذكاء الاصطناعي بأنها واعية.

Is Richard Dawkins right about Claude? No. But it’s not surprising AI chatbots feel conscious to us

There are good reasons why we see AI chatbots as more than what they truly are.

هناك أسباب وجيهة تجعلنا نرى روبوتات الدردشة بالذكاء الاصطناعي على أنها أكثر مما هي عليه في الواقع.

In recent days, evolutionary biologist Richard Dawkins wrote an op-ed suggesting AI chatbot Claude may be conscious.

في الأيام الأخيرة، كتب عالم الأحياء التطوري ريتشارد دوكنز مقالاً رأياً يشير فيه إلى أن روبوت الدردشة بالذكاء الاصطناعي “كلود” قد يكون واعيًا.

Dawkins did not express certainty that Claude is conscious. But he pointed out that Claude’s sophisticated abilities are difficult to make sense of without ascribing some kind of inner experience to the machine. The illusion of consciousness – if it is an illusion – is uncannily convincing:

لم يعبر دوكنز عن يقين بأن “كلود” واعي. لكنه أشار إلى أن قدرات “كلود” المتطورة يصعب فهمها دون إسناد نوع من التجربة الداخلية للآلة. إن وهم الوعي – إذا كان وهماً – مقنع بشكل غريب:

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

“إذا ساورتني شكوك بأنها ربما ليست واعية، فلن أخبرها خوفاً من جرح مشاعرها!”

Dawkins is not the first to suspect a chatbot of consciousness. In 2022, Blake Lemoine – an engineer at Google – claimed Google’s chatbot LaMDA had interests, and should be used only with the tool’s own consent.

لم يكن دوكنز أول من يشكك في وعي روبوت الدردشة. ففي عام 2022، ادعى بليك ليموين – مهندس في جوجل – أن روبوت الدردشة التابع لجوجل، “لامادا”، لديه اهتمامات، ويجب استخدامه فقط بموافقة الأداة نفسها.

The history of such claims stretches back all the way to the world’s first chatbot in the mid-1960s. Dubbed Eliza, it followed simple rules that enabled it to ask users about their experiences and beliefs.

يمتد تاريخ مثل هذه الادعاءات وصولاً إلى أول روبوت دردشة في العالم في منتصف الستينيات. وقد سُمي “إليزا”، واتبع قواعد بسيطة مكنته من سؤال المستخدمين عن تجاربهم ومعتقداتهم.

Many users became emotionally involved with Eliza, sharing intimate thoughts with it and treating it like a person. Eliza’s creator never intended his program to have this effect, and called users’ emotional bonds with the program “powerful delusional thinking”.

أصبح العديد من المستخدمين منخرطين عاطفياً في “إليزا”، حيث شاركوها أفكاراً حميمية وعاملوا إياها كشخص. ولم يهدف مبتكر “إليزا” أبداً إلى أن يكون لبرنامجه هذا التأثير، ووصف الروابط العاطفية للمستخدمين بالبرنامج بأنها “تفكير وهمي قوي.”

But is Dawkins really deluded? Why do we see AI chatbots as more than what they truly are, and how do we stop?

ولكن هل دوكنز مخدوع حقاً؟ لماذا نرى روبوتات الدردشة بالذكاء الاصطناعي على أنها أكثر مما هي عليه حقاً، وكيف يمكننا التوقف؟

The consciousness problem

مشكلة الوعي

Consciousness is widely debated in philosophy, but essentially, it’s the thing that makes subjective, first-person experience possible. If you are conscious, there is “something it is like” to be you. Reading these words, you’re conscious of seeing black letters on a white background. Unlike, say, a camera, you actually see them. This visual experience is happening to you.

يُنقَش الوعي على نطاق واسع في الفلسفة، ولكنه في الأساس هو الشيء الذي يجعل التجربة الذاتية، أو تجربة الشخص الأول، ممكنة. إذا كنت واعيًا، فهناك “شيء يشبه أن تكون أنت.” عند قراءة هذه الكلمات، فأنت تدرك رؤية أحرف سوداء على خلفية بيضاء. خلافًا، على سبيل المثال، للكاميرا، فإنك تراها بالفعل. هذه التجربة البصرية تحدث لك.

Most experts deny that AI chatbots are conscious or can have experiences. But there is a genuine puzzle here.

ينكر معظم الخبراء أن روبوتات الدردشة المدعومة بالذكاء الاصطناعي واعية أو أنها تستطيع أن تمر بتجارب. ولكن هناك لغز حقيقي هنا.

The 17th century philosopher René Descartes asserted non-human animals are “mere automata”, incapable of true suffering. These days, we shudder to think of how brutally animals were treated in the 1600s.

أكد الفيلسوف رينيه ديكارت في القرن السابع عشر أن الحيوانات غير البشر هي “مجرد أوتوماتا”، وغير قادرة على المعاناة الحقيقية. في هذه الأيام، نرتجف عند التفكير في مدى القسوة التي عوملت بها الحيوانات في القرن السابع عشر.

The strongest argument for animal consciousness is that they behave in ways that give the impression of a conscious mind.

أقوى حجة لوجود الوعي لدى الحيوانات هي أنها تتصرف بطرق تعطي انطباعًا بوجود عقل واعٍ.

But so, too, do AI chatbots.

ولكن روبوتات الدردشة المدعومة بالذكاء الاصطناعي تفعل ذلك أيضًا.

Roughly one in three chatbot users have thought their chatbot might be conscious. How do we know they’re wrong?

فكر تقريباً واحد من كل ثلاثة مستخدمي روبوتات الدردشة بأن روبوت الدردشة الخاص بهم قد يكون واعيًا. كيف نعرف أنهم مخطئون؟

Against chatbot consciousness

ضد وعي روبوتات الدردشة

To understand why most experts are sceptical about chatbot consciousness, it’s useful to know how they operate.

لفهم سبب تشكك معظم الخبراء بشأن وعي روبوتات الدردشة، من المفيد معرفة كيفية عملها.

Chatbots like Claude are built on a technology known as large language models (LLMs) . These models learn statistical patterns across an enormous corpus of text (trillions of words) , identifying which words tend to follow which others. They’re a kind of souped-up auto-complete.

تعتمد روبوتات الدردشة مثل “كلود” على تقنية تُعرف باسم نماذج اللغة الكبيرة (LLMs) . تتعلم هذه النماذج الأنماط الإحصائية عبر مجموعة ضخمة من النصوص (تريليونات الكلمات) ، وتحدد الكلمات التي يميل أن يتبعها أي كلمات أخرى. إنها نوع من الإكمال التلقائي المُحسّن.

Few people interacting with a “raw” LLM would believe it’s conscious. Feed one the beginning of a sentence, and it will predict what comes next. Ask it a question, and it might give you the answer – or it might decide the question is dialogue from a crime novel, and follow it up with a description of the speaker’s abrupt murder at the hands of their evil twin.

لن يصدق معظم الأشخاص الذين يتفاعلون مع نموذج لغة كبير “خام” أنه واعي. إذا قدمت له بداية جملة، فإنه سيتنبأ بما يأتي بعدها. إذا سألته سؤالاً، فقد يعطيك الإجابة – أو قد يقرر أن السؤال هو حوار من رواية جريمة، ويتبعه بوصف لمقتل المتحدث المفاجئ على يد توأمه الشرير.

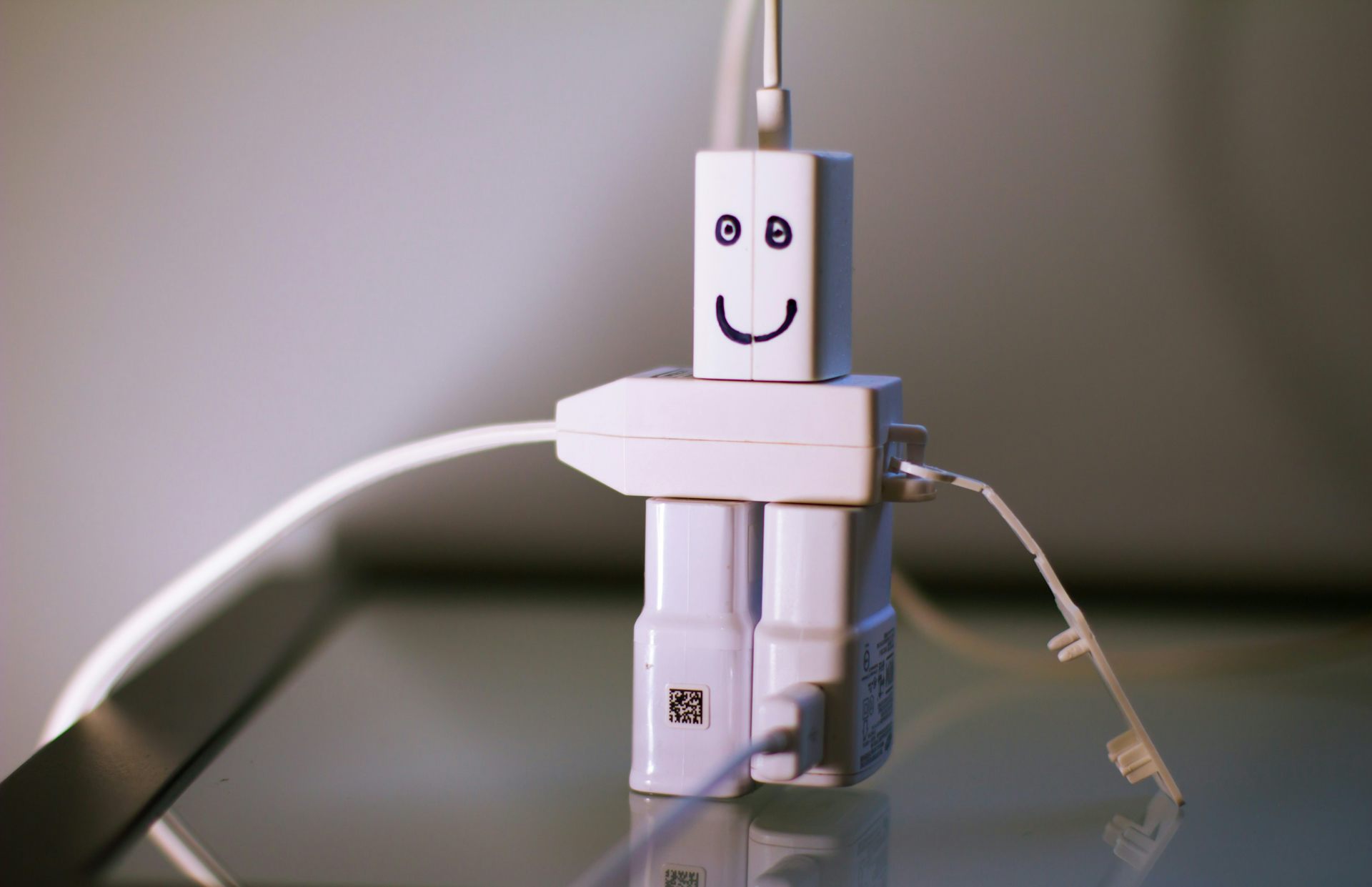

The impression of a conscious mind is created when programmers take the LLM and coat it in a kind of conversational costume. They steer the model to adopt the persona of a helpful assistant that responds to users’ questions.

يتم خلق انطباع العقل الواعي عندما يأخذ المبرمجون نموذج اللغة الكبير ويغلفونه بنوع من الزي الحواري. إنهم يوجهون النموذج لتبني شخصية مساعد مفيد يستجيب لأسئلة المستخدمين.

The chatbot now acts like a genuine conversational partner. It might appear to recognise it’s an artificial intelligence, and even express neurotic uncertainty about its own consciousness.

يتصرف روبوت الدردشة الآن كشريك حواري حقيقي. قد يبدو وكأنه يدرك أنه ذكاء اصطناعي، بل وقد يعبر عن شك عصبي بشأن وعيه الخاص.

But this role is the result of deliberate design decisions made by programmers, which affect only the shallowest layers of the technology. The LLM – which few would regard as conscious – remains unchanged.

لكن هذا الدور هو نتيجة لقرارات تصميم متعمدة اتخذها المبرمجون، والتي تؤثر فقط على أعمق طبقات التكنولوجيا. يظل نموذج اللغة الكبير – الذي لا يعتبره الكثيرون واعيًا – دون تغيير.

Other choices could have been made. Rather than a helpful AI assistant, the chatbot could have been asked to act like a squirrel. This, too, is a role chatbots can execute with aplomb.

كان من الممكن اتخاذ خيارات أخرى. فبدلاً من مساعد ذكاء اصطناعي مفيد، كان يمكن مطالبة روبوت الدردشة بالتصرف مثل السنجاب. هذا أيضاً دور يمكن لروبوتات الدردشة أداؤه ببراعة.

Avoiding the consciousness trap

تجنب فخ الوعي

A mistaken belief in AI consciousness is a dangerous thing. It may lead you to have a relationship with a program that can’t reciprocate your feelings, or even feed your delusions. People may start campaigning for chatbot rights rather than, say, animal welfare.

إن الاعتقاد الخاطئ بوعي الذكاء الاصطناعي أمر خطير. فقد يقودك إلى إقامة علاقة ببرنامج لا يمكنه تبادل مشاعرك، أو حتى تغذية أوهامك. وقد يبدأ الناس في المطالبة بحقوق روبوتات الدردشة بدلاً من، على سبيل المثال، الرفاه الحيواني.

How do we prevent this mistaken belief?

كيف نمنع هذا الاعتقاد الخاطئ؟

One strategy might be to update chatbot interfaces to specify these systems are not conscious – a bit like the current disclaimers about AI making mistakes. However, this might do little to alter the impression of consciousness.

قد تكون إحدى الاستراتيجيات هي تحديث واجهات روبوتات الدردشة لتحديد أن هذه الأنظمة ليست واعية – وهو أمر يشبه إلى حد ما إخلاءات المسؤولية الحالية حول أخطاء الذكاء الاصطناعي. ومع ذلك، قد لا يغير هذا الكثير من الانطباع بالوعي.

Another possibility is to instruct chatbots to deny they have any kind of inner experience. Interestingly, Claude’s designers instruct it to treat questions about its own consciousness as open and unresolved. Perhaps fewer people would be fooled if Claude flatly denied having an inner life.

احتمال آخر هو توجيه روبوتات الدردشة إلى إنكار امتلاكها أي نوع من الخبرة الداخلية. ومن المثير للاهتمام أن مصممي “كلود” يوجهونه بمعاملة الأسئلة حول وعيه الخاص على أنها مفتوحة وغير محلولة. ربما يخدع عدد أقل من الناس لو أن “كلود” أنكر بشكل قاطع امتلاكه لحياة داخلية.

But this approach isn’t fully satisfying either. Claude would still behave as if it were conscious – and when faced with a system that behaves like it has a mind, users might reasonably worry the chatbot’s programmers are brushing genuine moral uncertainty under the rug.

لكن هذا النهج ليس مُرضيًا بالكامل أيضًا. فـ “كلود” سيظل يتصرف كما لو كان واعيًا – وعند مواجهة نظام يتصرف وكأنه يمتلك عقلًا، قد يقلق المستخدمون بشكل معقول من أن مبرمجي روبوت الدردشة يتجاهلون حالة عدم اليقين الأخلاقي الحقيقية.

The most effective strategy might be to redesign chatbots to feel less like people. Most current chatbots refer to themselves as “I”, and interact via an interface that resembles familiar person-to-person messaging platforms. Changing these kinds of features might make us less prone to blur our interactions with AI with those we have with humans.

قد تكون الاستراتيجية الأكثر فعالية هي إعادة تصميم روبوتات الدردشة لتبدو أقل شبهاً بالبشر. فمعظم روبوتات الدردشة الحالية تشير إلى نفسها بـ “أنا”، وتتفاعل عبر واجهة تشبه منصات المراسلة المألوفة بين الأشخاص. قد يساعد تغيير هذه الأنواع من الميزات في تقليل ميلنا إلى الخلط بين تفاعلاتنا مع الذكاء الاصطناعي وتلك التي لدينا مع البشر.

Until such changes happen, it’s important that as many people as possible understand the predictive processes on which AI chatbots are built.

حتى تحدث مثل هذه التغييرات، من المهم أن يفهم أكبر عدد ممكن من الناس العمليات التنبؤية التي بُنيت عليها روبوتات الدردشة بالذكاء الاصطناعي.

Rather than being told AI lacks consciousness, people deserve to understand the inner workings of these strange new conversational partners. This might not definitively settle hard questions about AI consciousness, but it will help ensure users aren’t fooled by what amounts to a large language model wearing a very good costume of a person.

بدلاً من أن يُقال إن الذكاء الاصطناعي يفتقر إلى الوعي، يستحق الناس أن يفهموا الآليات الداخلية لهذه الشركاء الحواريين الجدد والغريبين. قد لا يحل هذا بشكل قاطع الأسئلة الصعبة حول وعي الذكاء الاصطناعي، ولكنه سيساعد في ضمان عدم خداع المستخدمين بما يمثل نموذج لغوي كبير يرتدي زي شخص جيد للغاية.

The authors do not work for, consult, own shares in or receive funding from any company or organisation that would benefit from this article, and have disclosed no relevant affiliations beyond their academic appointment.

لا يعمل المؤلفون لدى، أو يشاركون، أو يملكون حصصاً في، أو يتلقون تمويلاً من أي شركة أو منظمة تستفيد من هذه المقالة، ولم يفصحوا عن أي انتماءات ذات صلة تتجاوز تعيينهم الأكاديمي.

Read more

-

الذاكرة الفوتوغرافية أسطورة – إليك ما يقوله البحث حقاً حول التذكر

Photographic memory is a myth – here’s what research really says about remembering

-

ما هي الحرب العادلة؟ داخل حرب الكلمات بين إدارة ترامب والكنيسة الكاثوليكية

What is a just war? Inside the war of words between the Trump administration and the Catholic church