¿Tiene razón Richard Dawkins sobre Claude? No. Pero no es de extrañar que los chatbots de IA nos hagan sentir que son conscientes.

Is Richard Dawkins right about Claude? No. But it’s not surprising AI chatbots feel conscious to us

There are good reasons why we see AI chatbots as more than what they truly are.

Hay buenas razones por las que vemos a los chatbots de IA como algo más de lo que realmente son.

In recent days, evolutionary biologist Richard Dawkins wrote an op-ed suggesting AI chatbot Claude may be conscious.

En días recientes, el biólogo evolutivo Richard Dawkins escribió un artículo de opinión sugiriendo que el chatbot de IA Claude podría ser consciente.

Dawkins did not express certainty that Claude is conscious. But he pointed out that Claude’s sophisticated abilities are difficult to make sense of without ascribing some kind of inner experience to the machine. The illusion of consciousness – if it is an illusion – is uncannily convincing:

Dawkins no expresó certeza de que Claude sea consciente. Pero señaló que las sofisticadas habilidades de Claude son difíciles de entender sin atribuirle algún tipo de experiencia interna. La ilusión de conciencia – si lo es – es inquietantemente convincente:

If I entertain suspicions that perhaps she is not conscious, I do not tell her for fear of hurting her feelings!

¡Si sospecho que tal vez no es consciente, no se lo digo por miedo a herir sus sentimientos!

Dawkins is not the first to suspect a chatbot of consciousness. In 2022, Blake Lemoine – an engineer at Google – claimed Google’s chatbot LaMDA had interests, and should be used only with the tool’s own consent.

Dawkins no es el primero en sospechar que un chatbot es consciente. En 2022, Blake Lemoine, ingeniero de Google, afirmó que el chatbot de Google, LaMDA, tenía intereses y que solo debería usarse con el consentimiento de la propia herramienta.

The history of such claims stretches back all the way to the world’s first chatbot in the mid-1960s. Dubbed Eliza, it followed simple rules that enabled it to ask users about their experiences and beliefs.

La historia de tales afirmaciones se remonta al primer chatbot del mundo a mediados de la década de 1960. Llamado Eliza, seguía reglas simples que le permitían preguntar a los usuarios sobre sus experiencias y creencias.

Many users became emotionally involved with Eliza, sharing intimate thoughts with it and treating it like a person. Eliza’s creator never intended his program to have this effect, and called users’ emotional bonds with the program “powerful delusional thinking”.

Muchos usuarios se involucraron emocionalmente con Eliza, compartiendo pensamientos íntimos con él y tratándolo como a una persona. El creador de Eliza nunca tuvo la intención de que su programa tuviera este efecto, y llamó a los lazos emocionales de los usuarios con el programa «pensamiento delirante poderoso.»

But is Dawkins really deluded? Why do we see AI chatbots as more than what they truly are, and how do we stop?

Pero, ¿está Dawkins realmente engañado? ¿Por qué vemos a los chatbots de IA como algo más de lo que realmente son, y cómo podemos detenerlo?

The consciousness problem

El problema de la conciencia

Consciousness is widely debated in philosophy, but essentially, it’s the thing that makes subjective, first-person experience possible. If you are conscious, there is “something it is like” to be you. Reading these words, you’re conscious of seeing black letters on a white background. Unlike, say, a camera, you actually see them. This visual experience is happening to you.

La conciencia es ampliamente debatida en filosofía, pero esencialmente, es lo que hace posible la experiencia subjetiva y en primera persona. Si eres consciente, hay «algo que se siente» ser tú. Al leer estas palabras, eres consciente de ver letras negras sobre un fondo blanco. A diferencia, por ejemplo, de una cámara, tú realmente las ves. Esta experiencia visual te está sucediendo a ti.

Most experts deny that AI chatbots are conscious or can have experiences. But there is a genuine puzzle here.

La mayoría de los expertos niegan que los chatbots de IA sean conscientes o puedan tener experiencias. Pero aquí hay un verdadero enigma.

The 17th century philosopher René Descartes asserted non-human animals are “mere automata”, incapable of true suffering. These days, we shudder to think of how brutally animals were treated in the 1600s.

El filósofo del siglo XVII René Descartes afirmó que los animales no humanos son «meros autómatas», incapaces de sufrir de verdad. Hoy en día, nos estremecemos al pensar en lo brutalmente que fueron tratados los animales en los años 1600.

The strongest argument for animal consciousness is that they behave in ways that give the impression of a conscious mind.

El argumento más sólido a favor de la conciencia animal es que se comportan de maneras que dan la impresión de una mente consciente.

But so, too, do AI chatbots.

Pero los chatbots de IA también lo hacen.

Roughly one in three chatbot users have thought their chatbot might be conscious. How do we know they’re wrong?

Aproximadamente uno de cada tres usuarios de chatbots ha pensado que su chatbot podría ser consciente. ¿Cómo sabemos que están equivocados?

Against chatbot consciousness

Contra la conciencia de los chatbots

To understand why most experts are sceptical about chatbot consciousness, it’s useful to know how they operate.

Para entender por qué la mayoría de los expertos son escépticos sobre la conciencia de los chatbots, es útil saber cómo funcionan.

Chatbots like Claude are built on a technology known as large language models (LLMs) . These models learn statistical patterns across an enormous corpus of text (trillions of words) , identifying which words tend to follow which others. They’re a kind of souped-up auto-complete.

Los chatbots como Claude se basan en una tecnología conocida como modelos de lenguaje grandes (LLMs) . Estos modelos aprenden patrones estadísticos a partir de un enorme corpus de texto (billones de palabras) , identificando qué palabras tienden a seguir a cuáles otras. Son una especie de autocompletar mejorado.

Few people interacting with a “raw” LLM would believe it’s conscious. Feed one the beginning of a sentence, and it will predict what comes next. Ask it a question, and it might give you the answer – or it might decide the question is dialogue from a crime novel, and follow it up with a description of the speaker’s abrupt murder at the hands of their evil twin.

Pocas personas que interactúan con un LLM «en bruto» creerían que es consciente. Dale el comienzo de una oración y predecirá lo que sigue. Hazle una pregunta y podría darte la respuesta, o podría decidir que la pregunta es un diálogo de una novela de crimen, y continuar con una descripción del abrupto asesinato del orador a manos de su gemelo malvado.

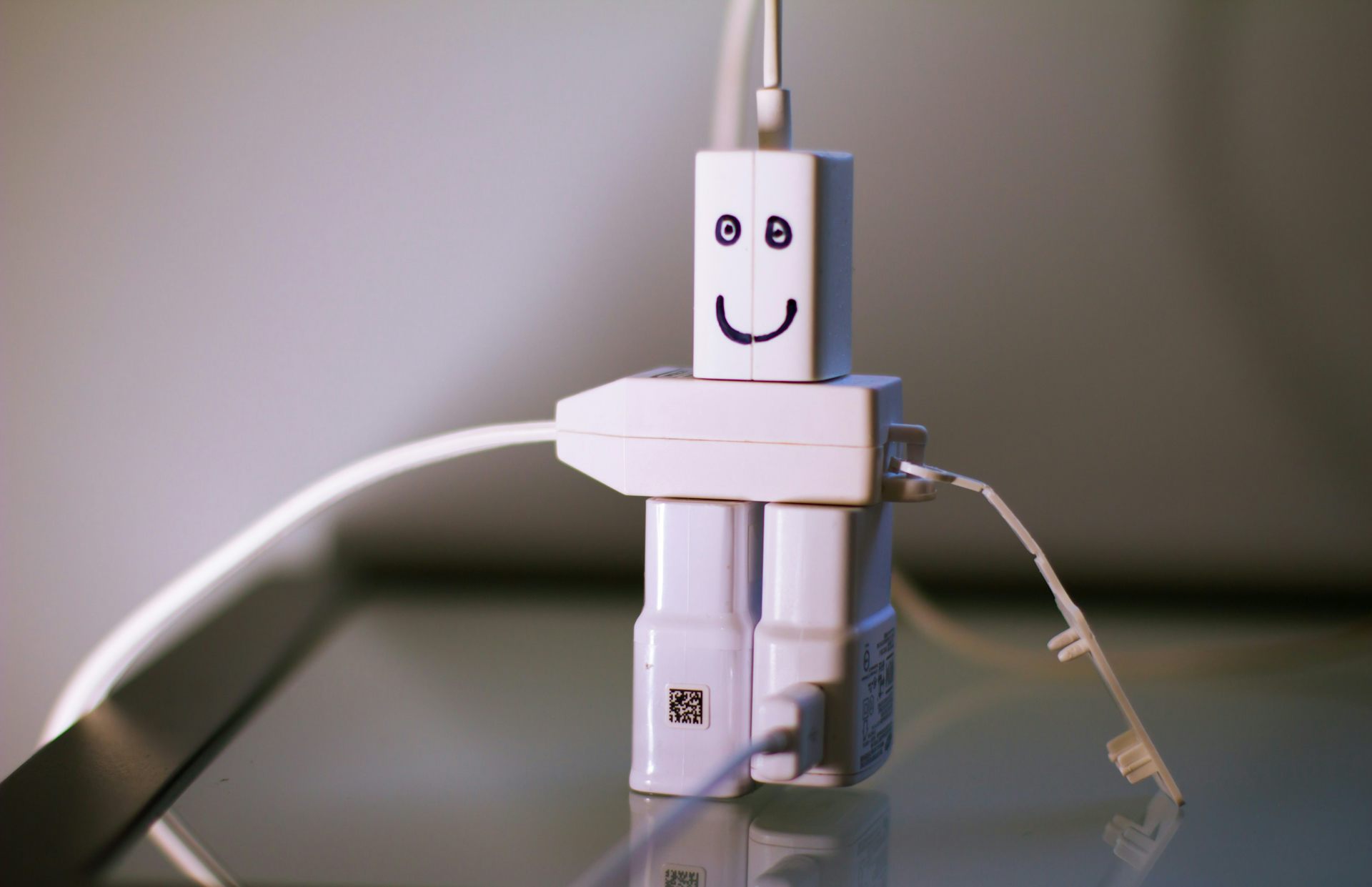

The impression of a conscious mind is created when programmers take the LLM and coat it in a kind of conversational costume. They steer the model to adopt the persona of a helpful assistant that responds to users’ questions.

La impresión de una mente consciente se crea cuando los programadores toman el LLM y lo visten con una especie de disfraz conversacional. Dirigen el modelo para que adopte la personalidad de un asistente útil que responde a las preguntas de los usuarios.

The chatbot now acts like a genuine conversational partner. It might appear to recognise it’s an artificial intelligence, and even express neurotic uncertainty about its own consciousness.

El chatbot ahora actúa como un verdadero compañero de conversación. Puede parecer que reconoce que es una inteligencia artificial, e incluso expresar incertidumbre neurótica sobre su propia conciencia.

But this role is the result of deliberate design decisions made by programmers, which affect only the shallowest layers of the technology. The LLM – which few would regard as conscious – remains unchanged.

Pero este papel es el resultado de decisiones de diseño deliberadas hechas por los programadores, que solo afectan a las capas más superficiales de la tecnología. El LLM – que pocos considerarían consciente – permanece sin cambios.

Other choices could have been made. Rather than a helpful AI assistant, the chatbot could have been asked to act like a squirrel. This, too, is a role chatbots can execute with aplomb.

Se podrían haber tomado otras decisiones. En lugar de un asistente de IA útil, se podría haber pedido al chatbot que actuara como una ardilla. Este también es un papel que los chatbots pueden ejecutar con aplomo.

Avoiding the consciousness trap

Evitando la trampa de la conciencia

A mistaken belief in AI consciousness is a dangerous thing. It may lead you to have a relationship with a program that can’t reciprocate your feelings, or even feed your delusions. People may start campaigning for chatbot rights rather than, say, animal welfare.

Creer erróneamente en la conciencia de la IA es algo peligroso. Puede llevarte a tener una relación con un programa que no puede corresponder a tus sentimientos, o incluso alimentar tus delirios. La gente puede empezar a hacer campaña por los derechos de los chatbots en lugar de, por ejemplo, el bienestar animal.

How do we prevent this mistaken belief?

¿Cómo podemos prevenir esta creencia errónea?

One strategy might be to update chatbot interfaces to specify these systems are not conscious – a bit like the current disclaimers about AI making mistakes. However, this might do little to alter the impression of consciousness.

Una estrategia podría ser actualizar las interfaces de los chatbots para especificar que estos sistemas no son conscientes, un poco como las exenciones de responsabilidad actuales sobre los errores de la IA. Sin embargo, esto podría poco alterar la impresión de conciencia.

Another possibility is to instruct chatbots to deny they have any kind of inner experience. Interestingly, Claude’s designers instruct it to treat questions about its own consciousness as open and unresolved. Perhaps fewer people would be fooled if Claude flatly denied having an inner life.

Otra posibilidad es instruir a los chatbots para que nieguen tener cualquier tipo de experiencia interna. Curiosamente, los diseñadores de Claude le indican que trate las preguntas sobre su propia conciencia como abiertas y sin resolver. Quizás menos gente se engañaría si Claude negara rotundamente tener una vida interior.

But this approach isn’t fully satisfying either. Claude would still behave as if it were conscious – and when faced with a system that behaves like it has a mind, users might reasonably worry the chatbot’s programmers are brushing genuine moral uncertainty under the rug.

Pero este enfoque tampoco es totalmente satisfactorio. Claude seguiría comportándose como si fuera consciente, y al enfrentarse a un sistema que se comporta como si tuviera mente, los usuarios podrían preocuparse razonablemente de que los programadores del chatbot estén ocultando una genuina incertidumbre moral.

The most effective strategy might be to redesign chatbots to feel less like people. Most current chatbots refer to themselves as “I”, and interact via an interface that resembles familiar person-to-person messaging platforms. Changing these kinds of features might make us less prone to blur our interactions with AI with those we have with humans.

La estrategia más efectiva podría ser rediseñar los chatbots para que parezcan menos humanos. La mayoría de los chatbots actuales se refieren como «yo» e interactúan a través de una interfaz que se asemeja a plataformas de mensajería persona a persona. Cambiar este tipo de características podría hacer que seamos menos propensos a confundir nuestras interacciones con la IA con las que tenemos con los humanos.

Until such changes happen, it’s important that as many people as possible understand the predictive processes on which AI chatbots are built.

Hasta que ocurran tales cambios, es importante que tantas personas como sea posible comprendan los procesos predictivos en los que se construyen los chatbots de IA.

Rather than being told AI lacks consciousness, people deserve to understand the inner workings of these strange new conversational partners. This might not definitively settle hard questions about AI consciousness, but it will help ensure users aren’t fooled by what amounts to a large language model wearing a very good costume of a person.

En lugar de que se les diga que la IA carece de conciencia, la gente merece comprender el funcionamiento interno de estos extraños nuevos compañeros de conversación. Esto podría no resolver definitivamente las difíciles preguntas sobre la conciencia de la IA, pero ayudará a garantizar que los usuarios no se dejen engañar por lo que equivale a un modelo de lenguaje grande que lleva un disfraz muy bueno de persona.

The authors do not work for, consult, own shares in or receive funding from any company or organisation that would benefit from this article, and have disclosed no relevant affiliations beyond their academic appointment.

Los autores no trabajan para, consultan, poseen acciones de, ni reciben financiación de ninguna empresa u organización que se beneficiaría de este artículo, y no han revelado afiliaciones relevantes más allá de su nombramiento académico.

Read more

-

«Aire fresco muy necesario»: 5 resultados de la primera cumbre mundial sobre el fin de los combustibles fósiles

‘Much-needed fresh air’: 5 outcomes from the world’s first summit on ending fossil fuels

-

Los códigos QR falsos facilitan estafas: ten cuidado con lo que escaneas por ahí

Fake QR codes make for easy scams – be careful what you scan out there